En este artículo explicaremos los conceptos más básicos de la física cuántica utilizando argumentos entendibles por cualquiera y detallando algunas deducciones importantes con algunos cálculos matemáticos al nivel de primeros cursos de universidad. Haremos un recorrido más histórico que axiomático para explicar cómo surgieron estos conceptos en las primeras décadas del siglo XX.

Experimentos que pusieron en crisis la física clásica

A principios del siglo XX, la física (que por entonces incluía lo que hoy llamamos mecánica clásica no relativista, termodinámica y estadística clásicas, y electrodinámica clásica, incluyendo la óptica geométrica y ondulatoria) parecía una disciplina casi completa, con la mayoría de los fenómenos a escala humana razonablemente explicados, y solo un par de misteriosas incógnitas en el horizonte.

Sin embargo, el desarrollo de instrumentos científicos más sofisticados dio lugar a una multiplicación de fenómenos observados que no podían explicarse desde una perspectiva clásica.

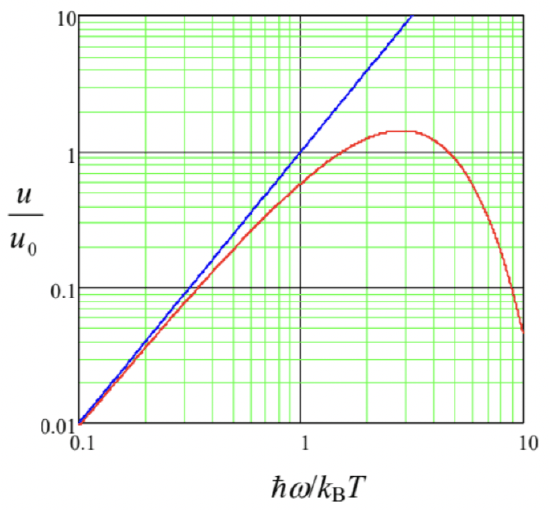

(i) Las mediciones de radiación de cuerpo negro, iniciadas por G. Kirchhoff en 1859, han demostrado que, en equilibrio térmico, la potencia de la radiación electromagnética emitida por una superficie totalmente absorbente («negra»), por unidad de intervalo de frecuencia, disminuye exponencialmente a altas frecuencias. Esto no se corresponde con lo que cabría esperar de la combinación de la electrodinámica clásica y la estadística, que predecían un crecimiento infinito de la densidad de radiación con la frecuencia.

Max Planck obtuvo una muy buena aproximación a la curva roja que muestran los experimentos mediante la expresión:

expresión que dedujo de estadística básica suponiendo (solo para ajustar los resultados experimentales para u) que los osciladores armónicos de las paredes sólo pueden emitir y absorber energía en paquetes proporcionales a la frecuencia angular de la pared:

.

Esto era bastante extraño para la época, puesto que la energía de un oscilador armónico es una función de su amplitud, y su frecuencia de oscilación es una propiedad del material (constante elástica), no es variable. Planck hizo esta hipótesis según él, “en un acto de desesperación”, al no encontrar manera alternativa de obtener una curva como la mostrada arriba.

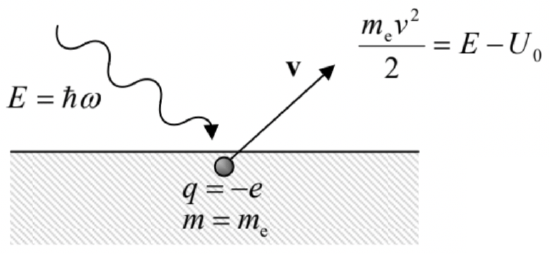

(ii) El efecto fotoeléctrico, descubierto en 1887 por H. Hertz y estudiado cuantitativamente por A. Stoletov en 1888-89, muestra un límite inferior bien definido («borde rojo») para la frecuencia de la luz incidente que puede expulsar electrones de superficies metálicas, independientemente de la intensidad de la luz incidente. Albert Einstein, en uno de sus tres famosos artículos de 1905, observó que este umbral podía explicarse asumiendo que la luz consistía en ciertas partículas (posteriormente llamadas fotones) con la misma relación entre energía y frecuencia que Planck había supuesto para el cuerpo negro:

De hecho, con esta suposición, en la absorción de un fotón por un electrón, su energía se divide entre una energía fija (actualmente llamada función de trabajo) de la unión del electrón dentro del metal y la energía cinética excedente del electrón liberado (véase la figura ). En esta imagen, el “borde rojo” encuentra una explicación natural como .

Fig. Efecto fotoeléctrico

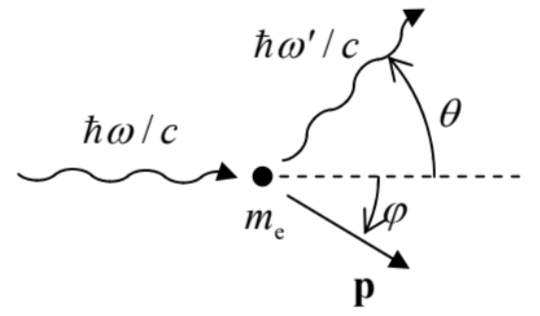

(iii) El efecto Compton (1923)

Es la reducción de la frecuencia de los rayos X al dispersarse en electrones libres o casi libres (ver Fig.), y parece demostrar la naturaleza corpuscular de la radiación.

Fig. Efecto Compton

Este efecto puede ser explicado suponiendo que los fotones que constituyen los rayos-X tienen un momento dado por la expresión:

Donde k es el vector de onda (cuya magnitud es igual al número de onda k y cuya dirección coincide con el vector unitario n dirigido a lo largo de la propagación de la onda), y que los momentos tanto del fotón como del electrón están relacionados con sus energías mediante la fórmula relativista clásica:

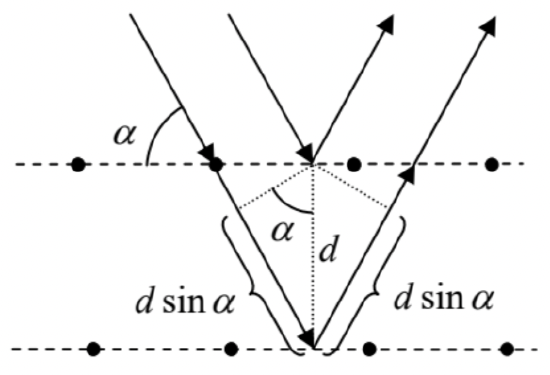

(iv) Difracción de partículas materiales. En 1927, Clinton Joseph Davisson y Lester Germer, e independientemente George Paget Thomson y Reid, lograron observar la difracción de electrones en cristales sólidos y en láminas metálicas muy finas. Son los primeros experimentos llamados genéricamente «de la doble rendija», que mostraban un comportamiento ondulatorio en las partículas materiales. Específicamente, encontraron que la intensidad de la reflexión elástica de electrones en un cristal aumenta bruscamente cuando el ángulo entre el haz incidente de electrones y los planos atómicos del cristal, separados por una distancia d, satisface la siguiente relación:

donde es la longitud de onda de De Broglie de los electrones, y n es un número entero. Como muestra la Fig., esta es precisamente la condición bien conocida de que la diferencia de camino

entre ondas reflejadas por dos planos cristalinos adyacentes coincida con un número entero de

, es decir, la condición para la interferencia constructiva de las ondas.

Fig. Aparente interferencia en la dispersión de un haz de electrones por una red cristalina

En resumen, todas las observaciones experimentales enumeradas podrían explicarse a partir de dos fórmulas muy simples (y de apariencia similar): la ecuación (1) (en aquel momento, solo para fotones) y la ecuación (2), tanto para fotones como para electrones: ambas relaciones involucran la misma constante de Planck.

Este hecho podría dar la impresión de que la evidencia experimental es suficiente para declarar que la luz consiste en partículas discretas (fotones) y, por el contrario, que los electrones son «ondas de materia» en lugar de partículas. Sin embargo, para entonces (mediados de la década de 1920), la física había acumulado evidencia abrumadora de las propiedades ondulatorias de la luz, como la interferencia y la difracción.

Además, también existía una sólida evidencia del comportamiento como partículas concentradas («corpusculares») de los electrones. Por ejemplo, los experimentos de la gota de aceite de Robert Andrew Millikan y Harvey Fletcher (1909-1913), mostraban que solo se podían añadir electrones individuales (¡y completos!) a una gota de aceite, cambiando su carga eléctrica total en múltiplos de la carga del electrón (-e) y nunca en una fracción.

Aparentemente, era imposible conciliar estas observaciones con una descripción puramente ondulatoria, en la que un electrón y, por lo tanto, su carga, deben distribuirse a lo largo de la extensión de la onda. Así que los físicos de las primeras décadas del siglo XX se enfrentaron a la formidable tarea de conciliar las propiedades ondulatorias y corpusculares de los electrones, los fotones, y otras partículas.

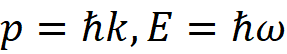

Un paso en esta dirección se debió a Louis De Broglie, que en 1924 propuso la existencia de ondas de materia en su tesis doctoral. Los experimentos comentados cobraban sentido según De Broglie si, tanto para la materia como para la radiación, la energía total de un ente se relaciona con la frecuencia de una onda asociada a su movimiento, por medio de la expresión:

Y el impulso p del ente se relaciona con la longitud de onda de esa onda asociada, por medio de:

Donde h es la constante de Planck.

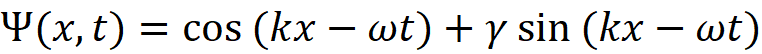

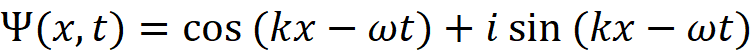

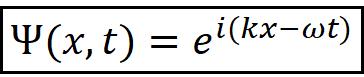

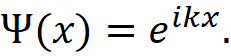

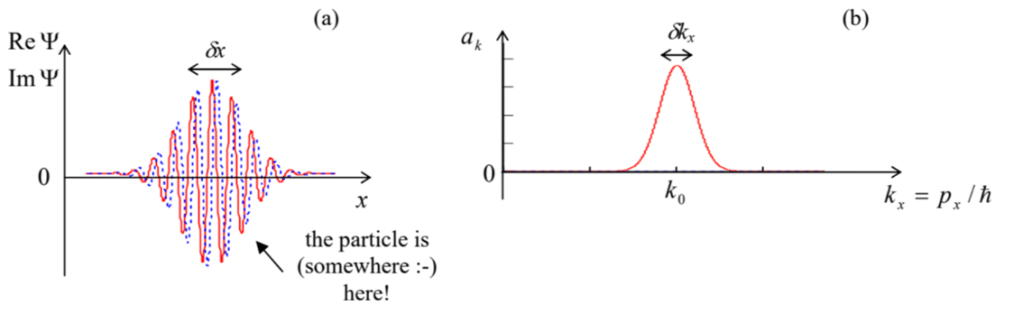

Fue también De Broglie quien en su tesis doctoral (Recherches sur la théorie des quanta, 1924), propuso que toda partícula material con impulso bien definido p, y energía bien definida E, tiene como onda asociada una onda monocromática viajera de la forma (ec. 5):

con las relaciones fundamentales:

Que es otra forma de escribir las expresiones (3) y (4), pues por definición: , y

.

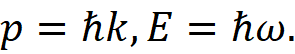

Fig. Ondas estacionarias asociadas al electrón en las primeras órbitas del átomo de hidrógeno, según De Broglie.

Esa onda viajera cuya parte real tiene forma sinusoidal es la misma que describe la propagación del campo eléctrico en una onda electromagnética. La intensidad de la radiación I en tal onda es proporcional al cuadrado de la amplitud promediada durante un ciclo. Desde el punto de vista corpuscular, esa intensidad I debería ser: , donde N es el número medio de fotones que cruzan una unidad de área perpendicular a la dirección de propagación, por unidad de tiempo. Fue Einstein quien propuso esta relación entre el campo eléctrico al cuadrado promediado, y el número de fotones que fluyen.

Esta semejanza, dio a Born la idea de que la ecuación de onda viajera (5), cuando describe la onda de De Broglie asociada a una partícula material, debe ser elevada al cuadrado y promediada para dar lugar a la probabilidad de encontrar a la partícula, por unidad de volumen, en determinado lugar en un tiempo t.

Pero esto ocurrió un año después de que Schrödinger se preguntara: ¿Qué ecuación tiene como soluciones ondas planas con las dos relaciones fundamentales anteriores para p y E?

Derivación de la ecuación de Schrödinger

El razonamiento de Schrödinger fue un tanto intrincado, pero aquí utilizaremos un método paralelo más ordenado y simple. La ecuación general de la función de onda asociada a una partícula de energía total E y momento p y sometida a una energía potencial externa V debería cumplir las siguientes condiciones plausibles:

- Satisfaría los dos postulados de De Broglie y Einstein (1) y (2).

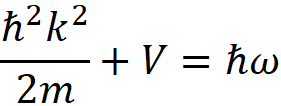

- Debería ser compatible con la ecuación que relaciona la energía total de una partícula de masa m con su energía cinética mas su energía potencial:

. En variables ondulatorias, esto equivale a:

- Deberá ser lineal en

. Esto es, que si tenemos dos soluciones de la ecuación, cualquier combinación lineal de ambas será también una solución. Esta aditividad de soluciones permite la suma y resta de ondas viajeras en las interferencias constructivas y destructivas típicas de las ondas electromagnéticas y de la difracción en óptica. Pero el experimento de la doble rendija demuestra que estas interferencias también ocurren en las ondas asociadas a las partículas materiales.

- Para el caso de energía potencial o potencial V = cte (en cuántica a la energía potencial se le suele llamar “potencial”) la ecuación debería dar como solución ondas sinusoidales viajeras como (5).

Tratemos de obtener la ecuación para el caso en que la partícula sólo se puede propagar en dirección x. Para que la ecuación de ondas sea lineal, sólo debería contener términos proporcionales a o a sus derivadas en t o en x, como ocurre en la ecuación de la propagación de las ondas electromagnéticas, pero no términos aditivos constantes ni términos proporcionales a \psi(x,t) elevado a una potencia 2 o mayor.

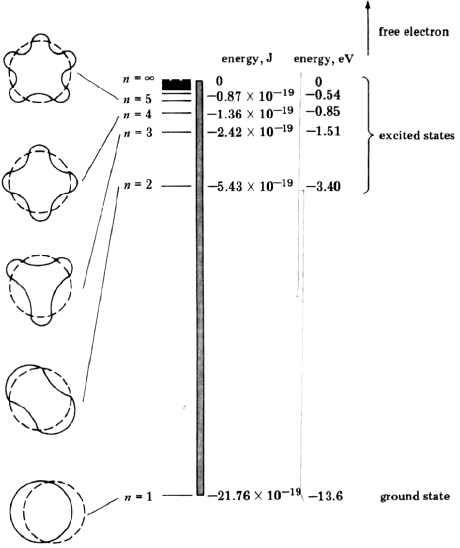

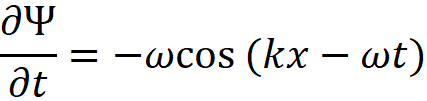

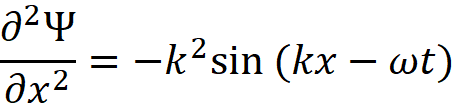

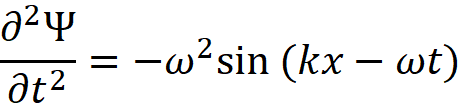

Para inspirarnos, es útil ver cómo afectan las primeras derivadas parciales en x y en t sobre la forma de la función de onda que parece apropiada para una partícula libre, la onda viajera sinusoidal (ec. 6):

donde (k) es el número de onda y la frecuencia angular:

Se ve que el efecto de tomar la segunda derivada espacial es introducir el factor -k2 y el efecto de derivar respecto a t es introducir el factor . Ya que se espera que la ecuación sea consistente con la expresión (ii), que contiene un factor k2 en un término y un factor \omega en otro, la ecuación podría contener una derivada segunda espacial de

y una derivada primera temporal de

. Pero también un término lineal que contenga a V(x,t), por ejemplo,

. Uniendo estas ideas podemos probar entonces con la siguiente ecuación:

Las constantes y

las tendremos que determinar exactamente y se han introducido para dar flexibilidad a la ecuación y que pueda satisfacer exactamente los requisitos (i) a (iv).

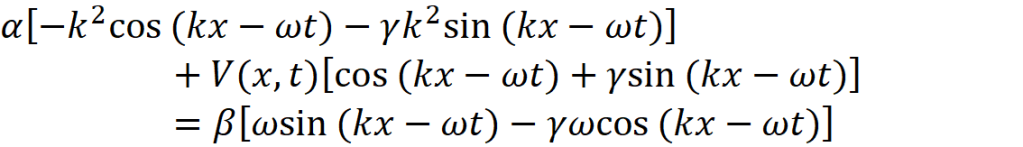

Para ver si esta ecuación funciona en detalle, supongamos que el potencial es constante V(x,t) = V0 y sustituyamos en ella la expresión de la onda viajera sinusoidal (6). Obtenemos entonces:

A pesar de haber añadido dos parámetros libres, vemos que nuestra onda viajera sinusoidal no consigue satisfacer la ecuación, porque la derivada temporal de convierte el seno en un coseno.

Este hecho sugiere que para la partícula libre, en vez de la senoidal simple (6), se utilice la combinación:

Sustituyendo esto en la ecuación de los dos parámetros libres y evaluando las derivadas necesarias se obtiene la igualdad:

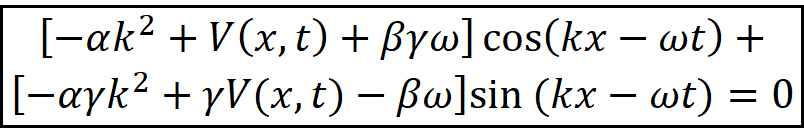

O lo que es lo mismo:

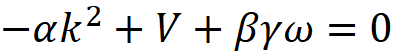

Para que la igualdad se cumpla para cualquier valor del coseno y el seno, es necesario que los corchetes sean ambos igual a cero. Esto implica las igualdades:

A las que añadimos además la condición (2):

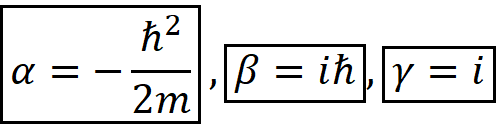

Resolvemos este sistema de tres ecuaciones algebraicas para las incógnitas . El resultado es (ec. 7, 8, 9):

o también , ambos resultados dan la misma física, así que nos quedamos con los dos signos positivos.

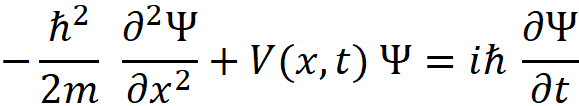

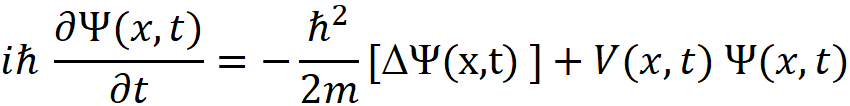

Sustituyendo (8) y (9) en la ecuación de partida obtenemos:

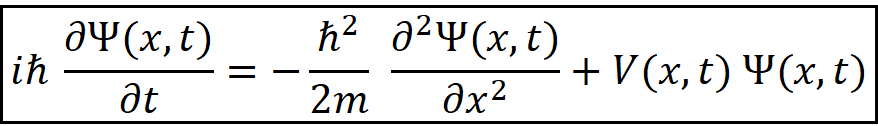

que es precisamente la ecuación dependiente del tiempo en una dimensión que Schrödinger obtuvo en 1926 (ec. 10):

Debye comenta que Schrödinger se inspiró en los trabajos de De Broglie para deducir esta ecuación:

Entonces De Broglie publicó su artículo. En este tiempo Schrödinger era mi sucesor en la Universidad de Zurich y yo estaba en la Universidad Técnica, que es un instituto federal, y tuvimos un coloquio juntos. Estuvimos hablando acerca de la teoría de De Broglie, coincidiendo en que no la entendíamos y que deberíamos pensar seriamente sobre sus formulaciones y lo que significan. Invité a Schrödinger a que nos diera un coloquio sobre el tema y sobre la preparación que realmente él hubiera obtenido. Transcurrieron solamente unos meses entre su plática y sus publicaciones.

Sustituyendo (9) en la ecuación de onda inicial, podemos obtener también:

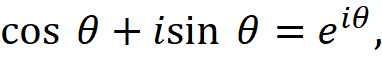

Que usando la identidad de Euler para números complejos:

puede escribirse también como (ec. 11):

Esta es la forma compleja estándar de la onda plana libre que satisface la ecuación de Schrödinger.

Obsérvese que el número imaginario i que aparece tanto en la ecuación como en la función de ondas ha derivado de la necesidad de satisfacer las 4 condiciones plausibles que impusimos, y de la imposibilidad de satisfacer esas condiciones con funciones de onda reales y operadores diferenciales reales. Suponemos que esta misma ecuación sigue siendo válida si el potencial V no es constante. Esto se ha comprobado empíricamente que es correcto.

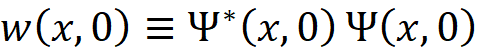

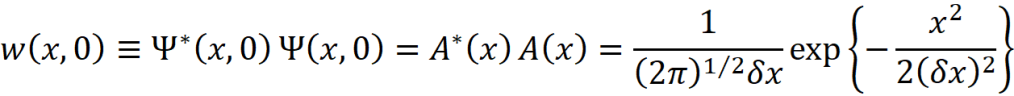

La función de ondas se supone que es en general una función compleja, no real. Esto induce a pensar que ella misma no tiene significado físico, y que es su norma (su cuadrado) o su valor absoluto (raíz cuadrada de la norma) lo que tienen significado físico. Fue Max Born el que postuló en 1926 que la norma de la función de ondas nos da la probabilidad por unidad de volumen de encontrar a la partícula alrededor de un punto espacial en el momento t. Por ejemplo, para t=0 tenemos (ec. 12):

Obsérvese que la función de ondas no sólo nos proporciona información de la probabilidad de encontrar la partícula en una posición, sino que también contiene una fase compleja que puede producir efectos de interferencia, análogos a los de las ondas electromagnéticas clásicas.

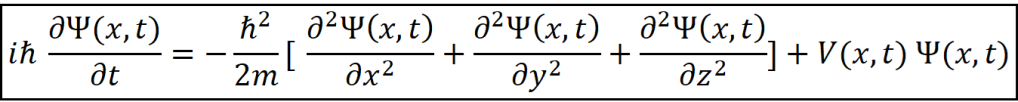

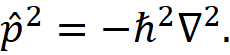

Schrödinger supuso que la ecuación (10) puede generalizarse para problemas en tres dimensiones espaciales, escribiendo (ec. 13):

Donde se escribe a veces el operador matemático laplaciana para agrupar las tres derivadas segundas espaciales:

Δ ∇2 = ∂2/∂x2 + ∂2/∂y2 + ∂2/∂z2, y la ecuación anterior se escribe como:

Fue también Schrödinger quien se dio cuenta de que todo el segundo miembro de esta ecuación representaba a un operador hamiltoniano válido para funciones de onda actuando sobre la función de ondas . Esta identificación la hizo inicialmente basándose en reglas intuitivas de correspondencia. En efecto:

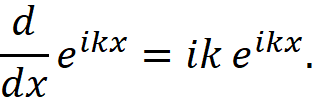

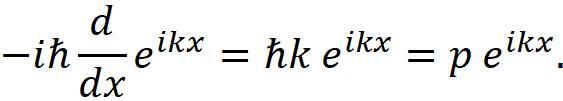

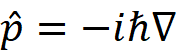

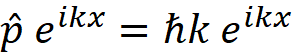

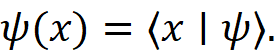

Sabemos desde De Broglie que la onda asociada a una partícula cumple:

Si una partícula tiene momento p, la onda asociada tiene número de onda k. Una onda plana se escribe:

Por tanto:

Multiplicando por :

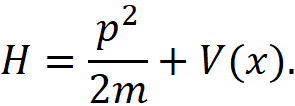

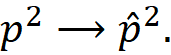

Es decir, el operador actúa sobre una onda plana exactamente como el momento p. Esto ya sugiere que ese operador representa el momento. En mecánica clásica:

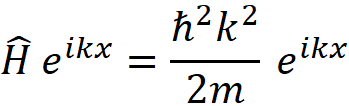

Si queremos una teoría cuántica que reproduzca el comportamiento clásico en el límite adecuado, debemos reemplazar:

Si

entonces:

Y así resulta que el término de la ecuación de Schrödinger que contiene la laplaciana corresponde exactamente con un operador energía cinética actuando sobre la función de ondas. De donde todo el segundo miembro de la ecuación es el operador hamiltoniano actuando sobre

. Aquí r es el vector de coordenadas espaciales (x,y,z).

Las aportaciones de Heisenberg

Hasta aquí hemos seguido el nacimiento de la Mecánica Cuántica hasta llegar a la función de ondas de Schrödinger. Pero antes de que Schrödinger publicara su ecuación en 1926, Heisenberg ya había creado la primera formulación completa y coherente de la mecánica cuántica: la mecánica matricial (1925). Este fue el primer marco matemático capaz de predecir correctamente los espectros atómicos sin recurrir a órbitas electrónicas clásicas como el Modelo de Bohr.

En su artículo de 1925 Über quantentheoretische Umdeutung kinematischer und mechanischer Beziehungen, Heisenberg eliminó completamente las órbitas electrónicas clásicas; reemplazó las magnitudes clásicas por tablas de números que representaban frecuencias y amplitudes observables; introdujo la idea de que las cantidades físicas debían describirse mediante matrices no conmutativas; y formuló las ecuaciones de movimiento cuánticas en términos de conmutadores. Max Born y Pascual Jordan demostraron después que las “tablas” de Heisenberg eran matrices, completando la teoría.

Heisenberg introdujo una idea radical: Solo deben aparecer en la teoría cantidades directamente observables, no variables no observables como órbitas de los electrones. Esto significó sustituir conceptos como la trayectoria del electrón, por otros como la frecuencias de transición entre niveles, así como reinterpretar las ecuaciones clásicas en términos cuánticos (“Umdeutung”). Este principio metodológico fue decisivo para romper con la vieja teoría cuántica de Bohr y Sommerfeld.

Heisenberg desarrolló una versión más precisa del principio de correspondencia de Bohr:

- Las ecuaciones cuánticas debían reducirse a las clásicas en el límite de grandes números cuánticos.

- Esto guió la construcción de las reglas de conmutación y de las ecuaciones de movimiento.

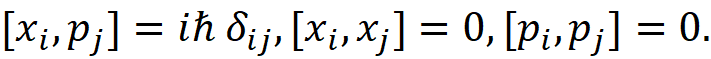

En la serie de artículos posteriores de 1925 Born y Jordan formalizaron matemáticamente la teoría de Heisenberg; introdujeron explícitamente las reglas de conmutación canónicas, que son:

Establecen que en mecánica cuántica los operadores asociados a las variables canónicas conjugadas (como x y px) no conmutan:

al contrario que en las relaciones canónicas clásicas.

Esto constituyó la base de la mecánica matricial, la ecuación de movimiento de Heisenberg, el principio de incertidumbre, y la ecuación de movimiento de Heisenberg.

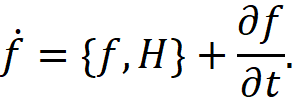

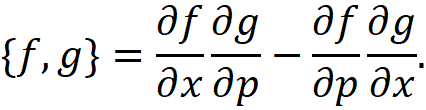

Esta ecuación es el análogo cuántico de la mecánica hamiltoniana clásica. En mecánica clásica, la evolución temporal de cualquier magnitud f(x, p, t) viene dada por la ecuación de movimiento en forma de Poisson:

donde es el corchete de Poisson:

Este objeto fue introducido por Poisson en su artículo Mémoire sur la théorie du mouvement des corps (1809). Cuando g se toma como la función hamiltoniano, y se tienen en cuenta las dos ecuaciones dinámicas para la variable espacial y para su momento asociado

descubiertas por Hamilton en 1835:

se obtiene la ecuación dinámica en forma de Poisson, con dentro del corchete.

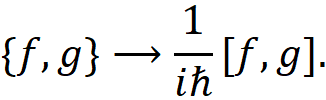

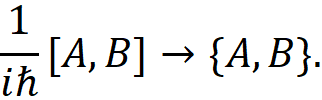

Heisenberg, Born y Jordan descubrieron que la estructura de la teoría cuántica exige reemplazar:

Esta sustitución es la única que reproduce correctamente:

- el espectro del hidrógeno,

- las reglas de cuantización,

- el principio de correspondencia,

- y la estructura algebraica de la teoría.

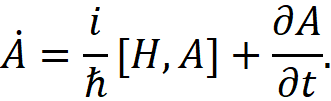

Aplicando esa sustitución a las ecuaciones de Hamilton, Heisenberg obtiene su ecuación de movimiento:

que es literalmente la versión cuántica de la correspondiente fórmula de Poisson. Además, reproduce la dinámica clásica en el límite . En ese límite:

que es el principio de correspondencia en su forma más precisa.

Esto estableció la mecánica matricial como una teoría completa y autónoma.

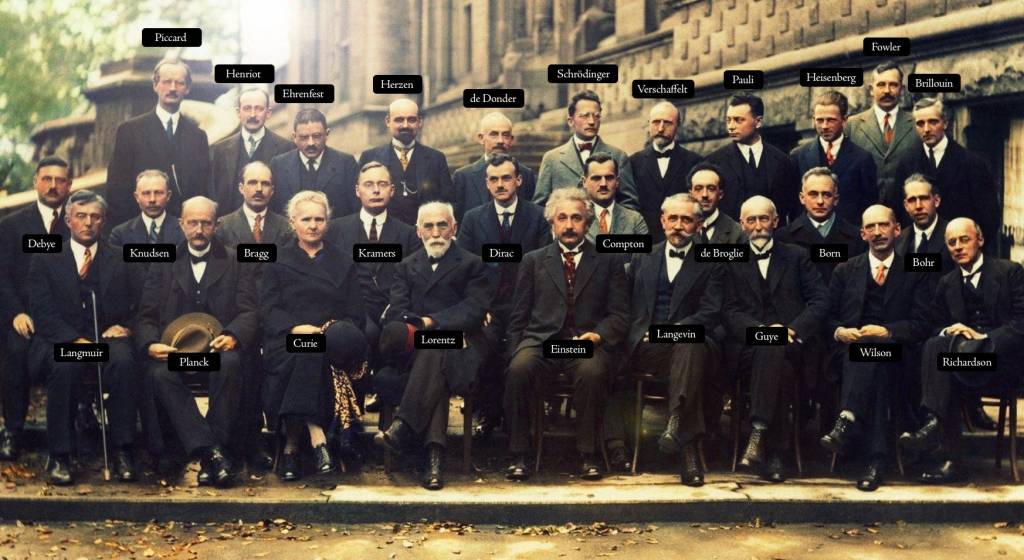

Foto. Conferencia de Solvay de 1927, en la que se reunieron la mayoría de los físicos creadores de la Mecánica Cuántica

Solución de la ecuación de Schrödinger para un potencial no dependiente del tiempo

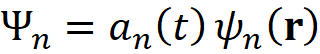

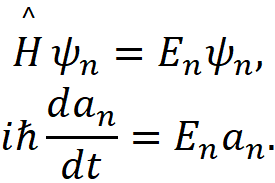

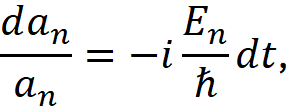

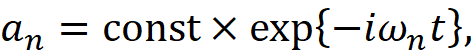

Una ecuación lineal como la de Schrödinger cuando el potencial es independiente de t resulta ser separable. Esto significa que podemos suponer que su solución es una función compuesta por el producto de dos funciones: una función dependiente sólo de r y otra dependiente sólo de t.

En efecto, sustituyamos en (13) la función (ec. 14):

Como el operador hamiltoniano está constituido por dos partes, cinética y potencial, que son lineales, se cumple la propiedad:

y dividiendo ambas partes de la ecuación por: obtenemos:

El lado izquierdo de esta ecuación puede depender solo del tiempo, mientras que el lado derecho, solo de las coordenadas. Estos hechos solo se pueden conciliar si asumimos que cada una de estas partes es igual a (la misma) constante con dimensiones de energía, y que denotaremos como . Como resultado, obtenemos dos ecuaciones separadas para las partes temporal y espacial de la función de onda (ecs. 15 y 16):

La última de estas ecuaciones, reescrita en esta forma:

es fácilmente integrable dando (ec. 17):

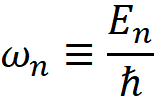

donde:

Así pues, Schrödinger observó que esta constante matemática hace que la ecuación temporal tenga la forma de una oscilación con frecuencia

. Ahora bien, esta igualdad es precisamente la relación de Planck que De Broglie usaba para relacionar la energía de una partícula con la frecuencia de oscilación de su onda asociada. Todo parecía indicar pues que se trata realmente de la energía de la partícula, y hemos añadido el subíndice n para indicar que en problemas con condiciones de contorno acotadas los autovalores sólo puede tomar valores discretos.

Si calculamos ahora la densidad de probabilidad de encontrar la partícula en (r,t) (ec. 18):

obtendremos que se reduce a:

que no depende del tiempo. Si la probabilidad es estacionaria, el valor medio y la varianza de cualquier propiedad ligada a la partícula, será también independiente de t.

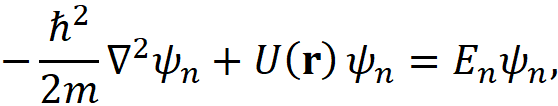

Nótese que para este potencial y este operador hamiltoniano, que son independientes del tiempo, la resolución de la ecuación de Schrödinger ha quedado reducida a resolver el problema (14). Esto significa encontrar los autovalores En de un operador diferencial lineal, y las autofunciones asociadas a esos autovalores, que son funciones dependientes de las coordenadas espaciales r = (x,y,z) (ec. 19):

Las matemáticas nos dicen que los problemas de este tipo tienen un conjunto (o espectro) de autovalores que puede ser discreto, continuo o mixto (discreto para ciertos rangos de valores de E y continuo para otros valores de E ). Esencialmente:

- será continuo si no hay potencial o el potencial es constante en todo el espacio infinito; en este caso, las

pueden tomar cualquier valor real

- será discreto si el potencial no alcanza un máximo absoluto en ningún punto del dominio, como en el caso del oscilador armónico, cuyo potencial siempre crece. O como en una partícula libre confinada en una caja, cuyas paredes implican un potencial que sube a infinito instantáneamente, confinando a la partícula.

- será mixto, si el potencial tiene uno o más mínimos locales de cierta profundidad, pero alcanza un máximo absoluto dentro del dominio infinito. Como en los potenciales electrostáticos, que tienden a un máximo de cero en el infinito. Para energías superiores a cero, aparece un espectro continuo de autovalores que satisfacen la ecuación. La interpretación física es que los mínimos locales del potencial confinan a las partículas cuya energía es inferior a la del máximo del potencial. Para cualquier dirección en que se muevan se encuentran con un potencial que crece, van perdiendo su energía cinética hasta que ésta se anula, y tienen que volver en dirección contraria. No consiguen salir nunca de tales pozos y por tanto su función velocidad o momento puede ser expresada como una función de x definida exclusivamente dentro de un espacio confinado. Y tales funciones son desarrollables en series de Fourier de espectro discreto.

Al igual que en nuestro problema de la función de ondas de una partícula libre con un potencial constante, hay problemas en física clásica que al ser resueltos mediante separación de variables, conducen a formas simples de la ecuación de Sturm-Liouville. Por ejemplo:

| Sistema físico | Ecuación |

| Cuerda vibrante | |

| Ecuación del calor | |

| Ondas EM 1D |

La forma más sencilla de operador de Sturm-Liouville unidimensional es la derivada segunda respecto a x. En un dominio finito de tamaño L este problema de autovalores es:

Para tales condiciones de contorno, los autovalores son:

Y las autofunciones:

El dominio finito obliga al número de ondas de la función seno a tomar valores que sean múltiplo entero de la longitud del dominio. Estas funciones:

- Son numerables (n = 1,2,…,

)

- forman una base ortogonal completa en el espacio de Hilbert de las funciones de cuadrado integrable definidas entre 0 y L: L2(0, L)

- generan la serie de Fourier seno.

Con otras condiciones de contorno (Neumann, periódicas) aparecen cosenos o exponenciales complejas.

La base de Fourier surge siempre que tenemos un operador cuya derivada más alta es la de un operador laplaciano. Por eso Fourier aparece en problemas de ondas, calor, cuántica, acústica, electromagnetismo y otros muchos campos.

Cuando el problema de autovalores está planteado en un dominio infinito sin condiciones de contorno, solo regularidad, la solución para

es:

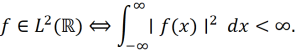

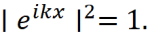

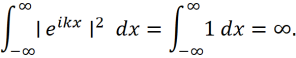

Aquí k es continuo, esto es, puede tomar cualquier valor real. Estas autofunciones armónicas no están en L2(R). En efecto, recordemos la definición de L2 (R):

Para una onda plana:

Entonces:

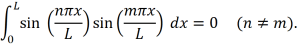

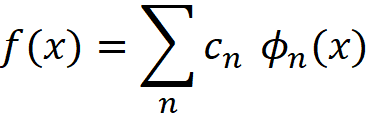

Luego las ondas planas no son cuadrado‑integrables. Pero hay una manera de generalizar las propiedades del espacio L2 (bases, producto escalar, ortogonalidad, norma, proyección sobre una base…) para esta nueva situación. Para ello, notemos que en un intervalo finito, la ortogonalidad es:

En L2, si intentamos lo mismo con ondas planas:

Esta integral no converge como número, pero sí converge en el sentido de la distribución delta de Dirac $latex \delta (k)$:

Inciso matemático sobre distribuciones y la generalización del espacio de Hilbert L2

Una forma intuitiva de entender qué es una distribución es precisamente entender la delta de Dirac como límite de una sucesión. El punto clave es que la Delta de Dirac no es una «función» en el sentido tradicional (donde cada punto x tiene un valor y definido), sino un límite de un proceso.

1. La Delta como «Límite de una Sucesión»

Imaginemos una sucesión de funciones (por ejemplo, gaussianas cada vez más estrechas o rectángulos cada vez más delgados). Si todas conservan el área unitaria (

), al hacer que su base tienda a cero, su altura debe tender a infinito para compensar.

- Para cualquier

, el valor de

tiende a 0.

- En x = 0, el valor tiende a

.

2. ¿Qué tiene que ver esto con las Distribuciones?

En matemática rigurosa, no podemos trabajar con «funciones que valen infinito». Por eso se inventaron las distribuciones (o funciones generalizadas). Una distribución no se define por lo que «es» en cada punto, sino por cómo actúa sobre otras funciones (llamadas funciones de prueba ).

En lugar de mirar el límite de la función aislada, miramos el límite de su integral (su producto escalar):

Como el resultado del límite es un número bien definido (), decimos que la sucesión converge a la distribución Delta.

3. La Generalización

Considerar a la Delta (o a la onda plana ) como una distribución significa que dejamos de preocuparnos por su valor punto a punto y pasamos a definirlas por su efecto dentro de una integral. Esto permite:

- Derivar funciones discontinuas: La derivada de un escalón es una Delta.

- Usar bases de energía infinita: Como las ondas planas, cuya «ortogonalidad» produce precisamente este tipo de límites (Deltas).

En resumen: la sucesión de funciones es el camino para construir el objeto, y la «distribución» es el objeto final que solo cobra sentido cuando «siente» a otra función dentro de una integral (véase https://www.reddit.com, https://es.wikipedia.org, https://www.reddit.com, https://www.reddit.com, https://www.reddit.com, https://wiki.seg.org).

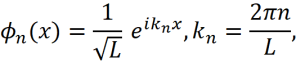

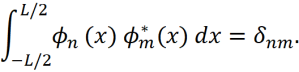

En un intervalo finito [0, L], el operador con condiciones periódicas tiene espectro discreto, y autofunciones que una vez normalizadas tienen la forma:

Y son ortonormales:

Aquí todo vive cómodamente en L2.

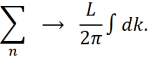

Pero si hacemos crecer el dominio L a , los valores permitidos de kn se densifican, porque la separación entre modos:

tiende a cero. En este límite, la suma discreta se convierte en una integral:

Este paso es exactamente el paso de un espectro discreto a uno continuo.

La normalización en el dominio finito era: . Pero cuando

, el factor

tiende a cero, la norma “se escapa al infinito” y la función deja de ser normalizable en L2(R). Por tanto, las ondas planas no convergen a funciones en L2(R).

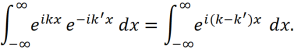

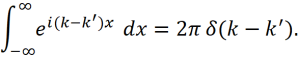

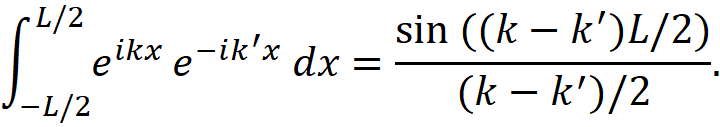

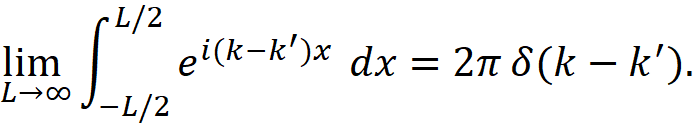

Consideremos el comportamiento en función de L del producto interno de dos ondas planas (ec. 20):

Cuando , esta expresión no converge como función, pero sí converge como distribución, dado que:

Donde d es una delta de Dirac. La figura siguiente muestra la transformación de la función (20) para k’=0, cuando el valor de L crece entre 10 y 100. Se observa que la función se vuelve cada vez más afilada y alta, pero manteniendo el área, que tiende a . Pero esto es precisamente lo que define a una distribución delta de Dirac.

Este proceso muestra que las autofunciones del espectro continuo e-ikx no son funciones de L2, son el núcleo de distribuciones (o vectores generalizados) definidas como funcionales que extraen la componente espectral de una función test. Estas distribuciones son normalizables, y la base ortogonal discreta se convierte en una base generalizada continua.

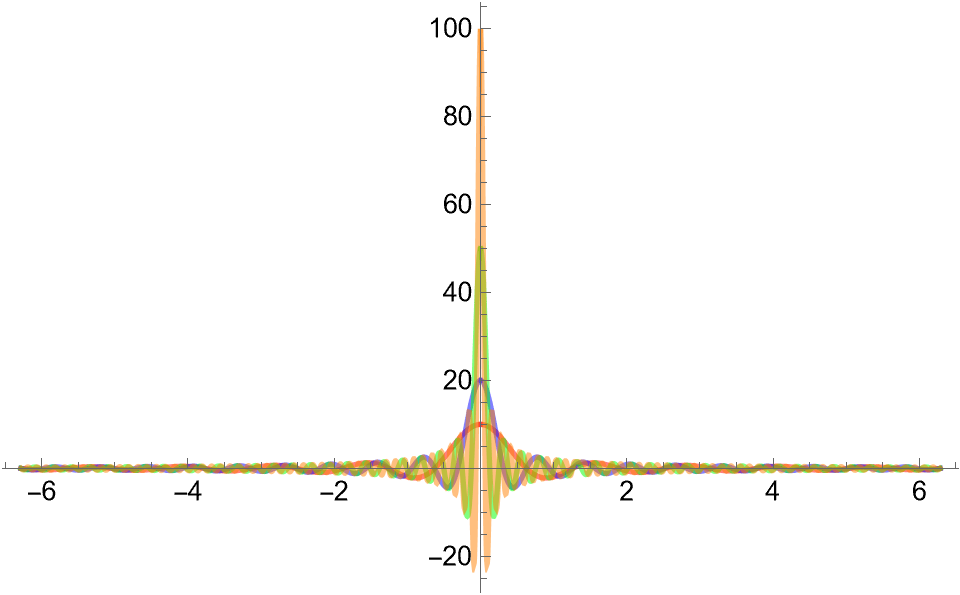

La expansión espectral pasa de:

a:

En este límite no es que “dejemos de usar funciones”, es que el espacio natural L2 se amplía a su dual, donde viven las distribuciones. La integral anterior es la versión distributiva del desarrollo en autofunciones cuando el espectro se vuelve continuo, y es la transformada de Fourier de f(x), salvo un factor de normalización

.

En situaciones en que tenemos un espectro continuo necesitamos ondas planas eikx no numerables sino con k continuo. El conjunto es una base si las exponenciales son consideradas el núcleo de una distribución o aplicación que se expresa mediante una funcional con ese núcleo actuando sobre funciones. Esta base es normalizable mediante el producto escalar que vimos antes y que nos da una delta de Dirac.

Al pasar de al espacio de las distribuciones (Espacio de Hilbert Equipado), los conceptos métricos se transforman para manejar «objetos» que no son cuadrados integrables.

1. La «Base» se vuelve Continua

En un espacio de Hilbert estándar, una base es discreta y sumable. En la generalización, usamos una base continua (o base de Dirac).

- Antes: Cualquier función se escribe como una suma:

.

- Ahora: Se usa una integral:

.

Las ondas planasactúan como «vectores unitarios» de un espacio de dimensión infinita no numerable, donde el índice ya no es n (1, 2, 3…), sino el parámetro continuo k.

2. El Producto Escalar se vuelve una Evaluación

El producto escalar tradicional falla si ambas funciones son ondas planas (la integral no converge). En el mundo de las distribuciones, el producto escalar se redefine como la acción de un funcional:

- Si tenemos una distribución

(como una delta o una onda plana) y una función «de prueba»

(espacio de Schwartz, funciones que decaen rápido), el producto escalar es simplemente el valor que la distribución asigna a esa función:

.

- Para dos ondas planas, el resultado es la ortogonalidad de Dirac:

. No es un número escalar, sino una distribución que solo cobra sentido cuando se integra después.

- Para una onda plana

, su producto escalar por una función f(x) es la función transformada de Fourier f(k) de esa función. La adjunta de la onda plana

actúa como núcleo de una funcional integral que actúa sobre f(x) para extraerle su composición espectral para todos los k.

3. La Norma y la Distancia

Aquí está el cambio más radical: las ondas planas no tienen una norma inducida en el sentido de L2.

- Si intentamos calcular

, obtenemos

, que es infinito.

- La solución es renunciar, en nuestra generalización, a que todos los elementos tengan una «longitud» finita. Solo las funciones que resultan de la combinación lineal (la integral) de esta base deben tener norma finita para ser consideradas «estados físicos».

En resumen: La generalización consiste en pasar de una geometría de puntos y distancias (Hilbert) a una geometría de operadores y distribuciones, donde las bases son etiquetas de un espectro continuo y el producto escalar es una herramienta para extraer coeficientes, no siempre para medir longitudes.

En el espacio de Hilbert L2, el producto escalar siempre debe devolver un escalar (un número). Sin embargo, al usar la «base» de ondas planas :

- El producto escalar actúa como una proyección.

- Proyectar

sobre toda la base

nos da el conjunto de todos los coeficientes simultáneamente.

Ese conjunto de todos los coeficientes es lo que llamamos en nuestro caso la función transformada de Fourier , que nos da el contenido espectral de la función para todos los

(salvo que calculemos la integral para un k=k0 fijo, que entonces obtendríamos la importancia de esa componente oscilatoria k0 en la función). Y recíprocamente, la integral transformada de Fourier inversa sería la expresión de cualquier función f(x) en términos de sus infinitas coeficientes espectrales multiplicados por cada una de las componentes de la base eikx. En lugar de un sumatorio, tenemos una integral.

solución general de la ecuación de schrödinger para una partícula libre

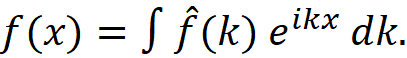

En 1926 Schrödinger planteó su ecuación y la resolvió para una partícula libre con potencial que se anula en el infinito, y para una partícula confinada en una caja, y lo hizo de una manera puramente formal o algebraica. Hablaba de funciones “suficientemente suaves”, soluciones de ecuaciones diferenciales, separación de variables, y condiciones de contorno físicas. Las matemáticas le decían que para estos dos problemas, el espectro de autovalores es discreto. Y encontró también que las autofunciones que obtenía eran ortogonales.

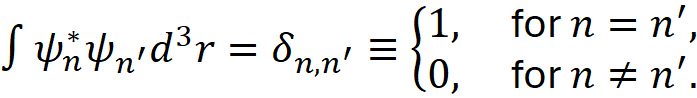

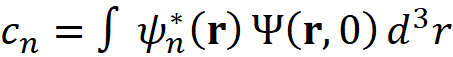

Debido a la linealidad de la ecuación de Schrödinger, cada una de estas funciones puede multiplicarse por un coeficiente constante adecuado para que su conjunto sea ortonormal (ec. 21):

Además, las autofunciones forman un conjunto completo, lo que significa que una función arbitraria, en particular la función de onda real del sistema en el momento inicial de su evolución, puede representarse como una expansión única sobre el conjunto de autofunciones (ec. 22):

Los coeficientes de expansión pueden hallarse fácilmente multiplicando ambos lados de la ecuación (18) por , integrando los resultados sobre el espacio y utilizando la ecuación (17). El resultado es (ec. 23):

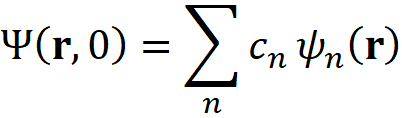

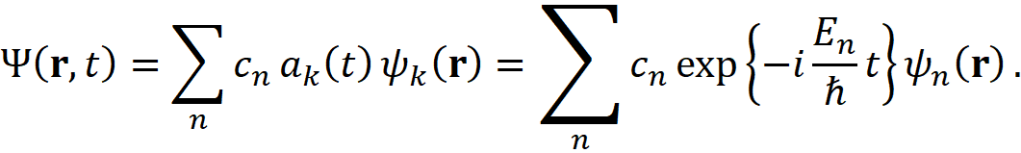

Ahora consideremos la siguiente función de onda (ec. 24):

Dado que cada término de la suma tiene la forma (14) y satisface la ecuación de Schrödinger, también lo hace la suma en su conjunto. Además, si los coeficientes se derivan de acuerdo con la ecuación (19), entonces la solución (24) también satisface las condiciones iniciales. En este momento podemos utilizar una pequeña ayuda más de los matemáticos, quienes nos dicen que la ecuación diferencial parcial lineal del tipo (13), con condiciones iniciales fijas, puede tener solo una (única) solución. Esto significa que en nuestro caso de hamiltoniano potencial independiente del tiempo, la ecuación (24) da la solución general de la ecuación de Schrödinger (13).

Schrödinger usó los conceptos de funciones ortogonales y ortonormales, aunque no lo formuló con el lenguaje moderno de espacios de Hilbert, porque esa teoría aún no existía. Pero el concepto matemático de ortogonalidad de funciones ya estaba plenamente establecido desde el siglo XIX. Desde Fourier (1822) y Sturm–Liouville (1830–1850), los matemáticos sabían que ciertos operadores diferenciales lineales tienen autofunciones ortogonales, esas autofunciones forman series completas, y se pueden usar para expandir funciones arbitrarias.

Ejemplos clásicos que Schrödinger conocía perfectamente:

- (

para todos los n forman una base ortogonal para funciones que se anulan en contornos finitos, como demostró Fourier

y

juntos para todos los n forman una base ortogonal para funciones que toman valores prefijados arbitrarios en contornos finitos

- los modos de vibración de una cuerda son ortogonales,

- los conjuntos de polinomios llamados de Legendre, Hermite, Laguerre… son ortogonales.

Cuando Schrödinger resuelve la ecuación de onda cuántica en 1926, él separa variables, obtiene una ecuación de tipo Sturm–Liouville (la ecuación 14), y usa directamente el resultado conocido de que las autofunciones de un operador de Sturm–Liouville son ortogonales. Schrödinger predijo que estas constantes En que tienen dimensiones de energía, que cumplen la relación de Planck, y que son autovalores del operador hamiltoniano en la ecuación, tenían que ser los valores discretos de energía que el sistema, la partícula libre en nuestro caso, puede tomar. Años después se confirmó que esos autovalores coinciden exactamente con los valores experimentalmente observables para la energía cuantizada, en ese problema y en varios otros, como el oscilador armónico y el átomo de hidrógeno.

En un famoso artículo de 2026 inmediatamente después del publicado por Schrödinger, Born llegó a fórmulas explícitas para interpretar la función de ondas como una probabilidad, así como para calcular el valor medio o esperado de cualquier observable. Lo hizo de forma intuitiva, pues no conocía aún la formulación moderna de Dirac y Von Neumann, que interpretan un “observable” como un “operador autoadjunto”.

Born estaba trabajando sólo con la función de onda de Schrödinger y con la idea de que debía tener un significado probabilístico. Y sabía tres cosas fundamentales:

✔ 1. La función de onda es compleja, así que no puede interpretarse como una densidad física.

✔ 2. es siempre real y positivo y podría interpretarse como una densidad de probabilidad.

✔ 3. Las magnitudes físicas no tienen valores definidos, solo se pueden predecir probabilidades de resultados.

Con esto, Born dio el salto conceptual de pensar que la mecánica cuántica no describe trayectorias, sino distribuciones de probabilidad.

¿Qué necesitaba Born? Una forma de calcular promedios. Si es una densidad de probabilidad, entonces para cualquier magnitud física (A), el valor promedio debería ser:

Esto es exactamente lo que se haría en estadística clásica. Pero aquí aparece el problema: En cuántica, muchas magnitudes NO son funciones de (x). Por ejemplo:

- el momento cuántico p, obtenido antes mediante un razonamiento de equivalencia, no es una función de x,

- la energía depende de derivadas en las coordenadas espaciales.

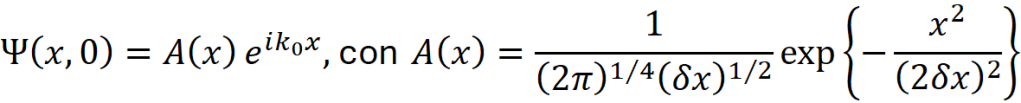

- el momento angular se obtiene partiendo de su expresión clásica:

. Sustituimos x por

, px por

, etc., y obtenemos:

que también es un operador diferencial, no una función de la posición.

Entonces Born necesitaba una forma de generalizar la idea de “multiplicar por A(x)” a casos donde A no es una función sino una transformación. Y razonó así: Si una magnitud física no puede representarse como una función, entonces debe representarse como una operación sobre la onda. Por ejemplo: el momento debe actuar como una derivada; la energía como el operador de Schrödinger; el momento angular como una derivada angular. Así nació la idea embrionaria de operador. Y entonces, el promedio debe ser:

Que es exactamente (ec. 21):

En esa fórmula, < … > significa el promedio estadístico, es decir, el resultado de promediar los resultados de medición en un gran conjunto de experimentos macroscópicamente similares, y es la función de onda normalizada.

¿Por qué esta forma y no otra? Porque Born exigió tres condiciones:

✔ (i) El valor esperado debe ser real. Esto obliga a que:

sea real para cualquier . Eso implica que

debe ser hermítico (aunque Born no usó ese término aún).

✔ (ii) Debe reducirse a la fórmula clásica cuando (A(x)) es una función

Si (A) es solo multiplicación por una función: , y la fórmula de Born se reduce a:

que es exactamente el promedio clásico.

✔ (iii) Debe ser lineal

Porque la ecuación de Schrödinger es lineal, y la teoría debe ser coherente.

Estas tres condiciones determinan la fórmula de Born para el valor medio de un observable de manera prácticamente única. En esa fórmula, <…> significa el promedio estadístico, es decir, el resultado de promediar los resultados de medición en un gran conjunto de experimentos macroscópicamente similares, y es la función de onda normalizada.

Todo este conjunto de propiedades sorprendentes empezó a olerle a chamusquina a Paul Dirac. Dirac ha sido considerado por muchos como el físico más genial del siglo XX después de Einstein. Empezó a desarrollar un formalismo que usaba distancia entre funciones, productos escalares entre funciones, autofunciones como bases funcionales ortogonales completas, proyección de una función sobre una autofunción componente de una base, etc. Estaba traduciendo, sin saberlo, los resultados de la teoría cuántica a la estructura matemática que Hilbert había desarrollado entre 1900 y 1920.

Von Neumann era matemático y sí conocía profundamente los trabajos de Hilbert. Fue él quien identificó de qué estaba hablando Dirac y afirmó: “La mecánica cuántica es teoría de operadores autoadjuntos en espacios de Hilbert.”

¿Usó Schrödinger explícitamente el producto interno de funciones integrables? Esto es lo que define a un espacio pre-hilbertiano de funciones. Sí que lo hizo, pero de forma “ingenua”, sin el formalismo moderno, que fue desarrollado posteriormente por Von Neumann entre 1927 y 1932. Usaba expresiones como:

porque eso ya era parte de la teoría clásica de Sturm–Liouville.

Schrödinger no decía “producto interno en (el espacio de las funciones de cuadrado integrable)” ni “operador autoadjunto”, pero hacía exactamente lo mismo. Aunque Schrödinger no lo llamaba así, estaba trabajando en

(el espacio de las funciones acotadas de cuadrado integrable).

Fue tras Von Neumann que quedó claro que, en un espacio de Hilbert, hay un producto escalar de la función por ella misma (o módulo al cuadrado de la función), hay una integral de dicho producto escalar, cuya raíz cuadrada define una norma, y hay una distancia entre dos funciones que es la norma del producto escalar de la diferencia entre esas funciones (o raíz del área de la diferencia cuadrática entre ambas funciones). Y que si el operador es autoadjunto en un espacio de Hilbert H de funciones, las autofunciones correspondientes a diferentes autovalores son ortogonales y forman una base completa en dicho espacio de funciones. Pero que si el espectro de autovalores es continuo, las autofunciones no son ortogonales en el propio espacio H sino en un espacio ampliado de distribuciones.

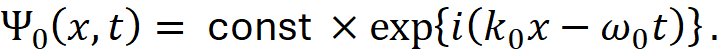

Centrémonos ahora en el problema de la partícula libre, esto es, con un potencial nulo o constante, en un dominio infinito. Pero supondremos que la función de ondas inicial no es una simple onda plana sino un paquete de ondas localizado en el espacio con una cierta anchura.

En el caso de nuestra función de onda de partícula libre con un momento y energía bien definidos, teníamos una expresión del tipo:

Multiplicando por su conjugada vemos que la probabilidad de encontrar la partícula en x es una constante independiente de x, lo cual implica que su probabilidad es la misma para todo punto x del espacio, y es fácil ver que se mantendrá así para cualquier otro tiempo t. La partícula está uniformemente deslocalizada en todo el espacio.

Para describir un estado localizado espacialmente, formemos, en el instante inicial, un paquete de ondas del tipo mostrado en la figura.

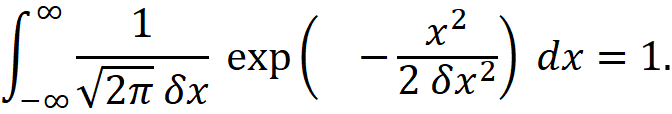

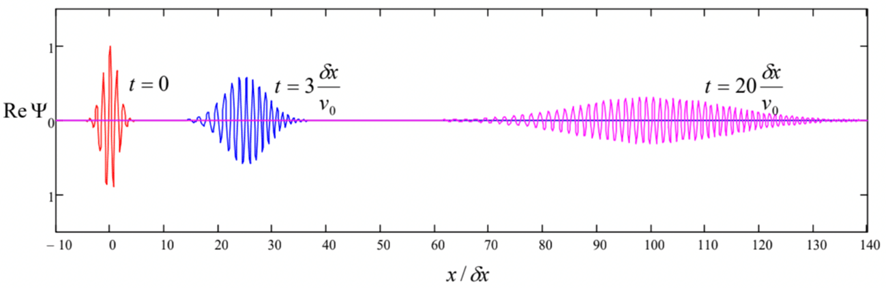

Para ello multiplicamos la forma de onda sinusoidal por una función envolvente suave. Como ejemplo particular, consideremos el paquete de ondas gaussiano de varianza (ec. 25):

Donde el factor delante de la exponencial se ha elegido de modo que la densidad de probabilidad por unidad de longitud-x esté normalizada a 1 si integramos en todo x (ec. 26):

En efecto, el “área” de la función de probabilidad para todo x es:

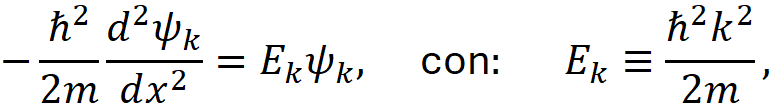

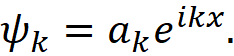

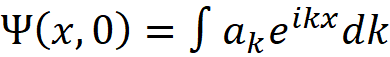

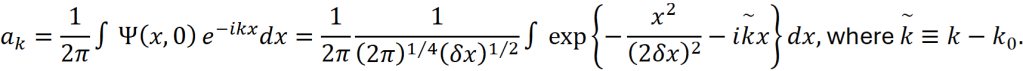

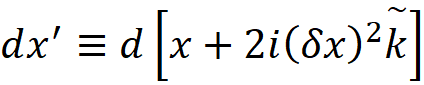

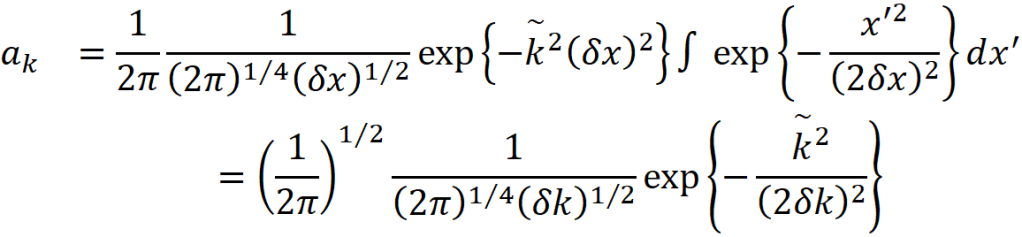

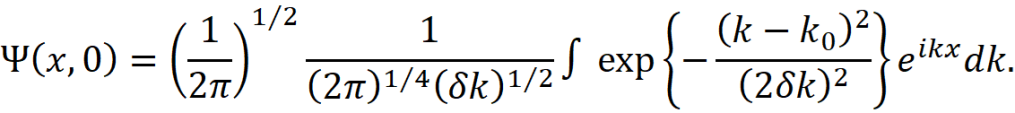

Para explorar la evolución de este paquete de ondas en el tiempo, podríamos intentar resolver la ecuación de Schrödinger con esta condición inicial (25) directamente, pero es más fácil proceder de manera diferente. Representemos primero la función de onda inicial (25) como una suma de las funciones propias de la ecuación de Schrödinger estacionaria 1-D correspondiente, en nuestro caso:

que son simplemente ondas monocromáticas (ec. 27):

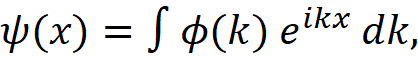

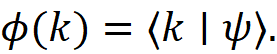

Dado que (como se discutió antes) en el movimiento no restringido el espectro de posibles números de onda es continuo, la suma debe reemplazarse con una integral (ec. 28):

Ahora observemos que desde el punto de vista de las matemáticas, la ecuación (28) es simplemente la transformada de Fourier usual de la variable k a la variable «conjugada», y podemos usar la fórmula bien conocida de la transformada de Fourier recíproca para escribir (ec. 29):

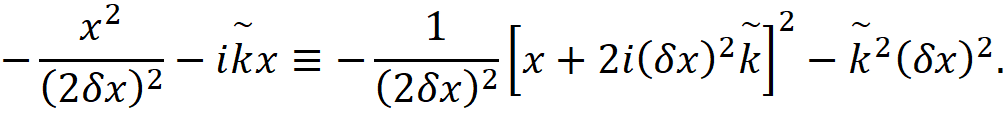

Esta integral gaussiana se puede calcular mediante el siguiente método estándar. Complementemos el exponente al cuadrado completo de una combinación lineal de x y k, agregando un término compensador independiente de x:

Dado que la integración en el lado derecho de la Ec. (29) debe realizarse a constante , en los límites infinitos de x, su resultado no cambiaría si reemplazamos dx por:

Como resultado obtenemos (ec. 30):

donde hemos utilizado el hecho de que la integral infinita:

Hemos obtenido otra distribución gaussiana, ahora a lo largo del eje k, centrada en el valor k0 (Figura), con la constante definida como (ec. 31):

Así podemos representar el paquete de ondas inicial como (ec. 31):

Esto es una combinación lineal de ondas elementales eikx con un número de onda k determinado y viniendo afectada cada onda elemental por el coeficiente , donde ak es la transformada de Fourier del paquete inicial en x, sumadas (integradas) para todos los k. Si esta combinación no tuviera más que un solo término

, el resultado de una medida de k sería naturalmente k0. Si ak no tiene valores significativos mas que en un entorno pequeño de k0, la experiencia demuestra que el valor que se mide está probablemente muy cerca de k0. Generalizando, resulta muy plausible que la probabilidad

de encontrar un valor de k en el intervalo (k, k+dk) es tanto más grande cuanto mayor sea

. Por tanto, Born supuso que:

Además, era conocido que la transformación de Fourier conserva el producto escalar, esto es:

Y la normalización de la probabilidad se satisface automáticamente. Para que todo sea coherente es necesario que la norma de las funciones de onda permanezcan constantes en el tiempo. Ahora bien, la función de ondas y su compleja conjugada satisfacen las siguientes ecuaciones de Schrödinger:

Por tanto,

Integrando los dos miembros de esta ecuación en todo el espacio de fases resulta:

Para que la norma permanezca constante a lo largo del tiempo es necesario y suficiente que:

propiedad que debe cumplirse para cualquier función de ondas de cuadrado integrable en el espacio de fases. Pero esto es justamente lo que define en matemáticas a un operador hermítico.

Todo esto dio a Dirac una serie de ideas que le llevaron a su formalización matemática. En primer lugar, la transformada de Fourier no es un truco matemático, sino el cambio entre dos bases físicas del espacio de Hilbert. Y la regla (32) no era otra cosa sino la aplicación del postulado de Born (de que la función de onda al cuadrado da la probabilidad de encontrar al observable), pero aplicado en la base de los autovalores del operador momento. Esto es: Las funciones eikx no son solo “modos de Fourier” por conveniencia matemática. Son autofunciones del operador momento:

Y también autofunciones del hamiltoniano de la partícula libre:

Por tanto, la base es la base de autovectores del momento, que para una partícula libre, coincide con la base de autovectores de la energía (salvo la degeneración

).

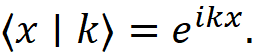

Dirac distinguió también entre representación y base del desarrollo:

🔹 Representación

Cuando escribimos , estamos escribiendo el estado del sistema

en la representación de posición (proyectando sobre las autofunciones generalizadas del operador posición):

🔹 Base del desarrollo o expansión

Cuando escribimos

estamos expandiendo el estado en la base , donde:

Así que, dicho con precisión: el paquete de ondas está expresado en la representación de posición, pero expandido en la base de autofunciones del momento (y de la energía, en el caso libre).

La interpretación física de la función es la de amplitud del estado en la base de momentos:

Y su módulo al cuadrado da la densidad de probabilidad de medir un momento

. Y finalmente, cada observable debía estar representado por un operador hermítico.

Si efectuamos la operación (32) con nuestra expresión para ak (30) obtenemos una función gaussiana de desviación típica , similar en forma a la gaussiana que se obtenía al calcular la densidad de probabilidad de la posición x de la partícula en el paquete inicial de ondas (ec. 26). Si definimos la incertidumbre de un observable como su desviación típica, podemos calcular el producto de incertidumbres de x y de p:

Es evidente que la incertidumbre del número de onda en este paquete es de hecho igual a la definida por el paquete de ondas en x del principio, justificando así la notación.

Se puede demostrar que el paquete gaussiano representa el caso extremo en el que el producto tiene el valor más bajo posible; para cualquier otra forma de envolvente, el producto de incertidumbres solo puede ser mayor, y esto es el principio de incertidumbre que enunció Heisenberg.

Como ya sabemos que la evolución temporal de la función de onda siempre viene dada por la ecuación (24), para nuestro caso actual (ec. 33):

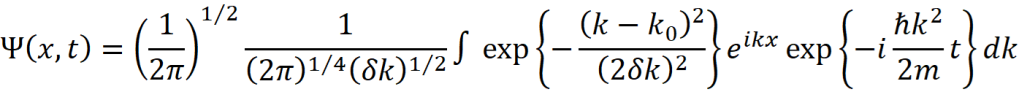

Fig. Instantáneas de la parte real del paquete de ondas en dos tiempos diferentes, según la ec. (33), para

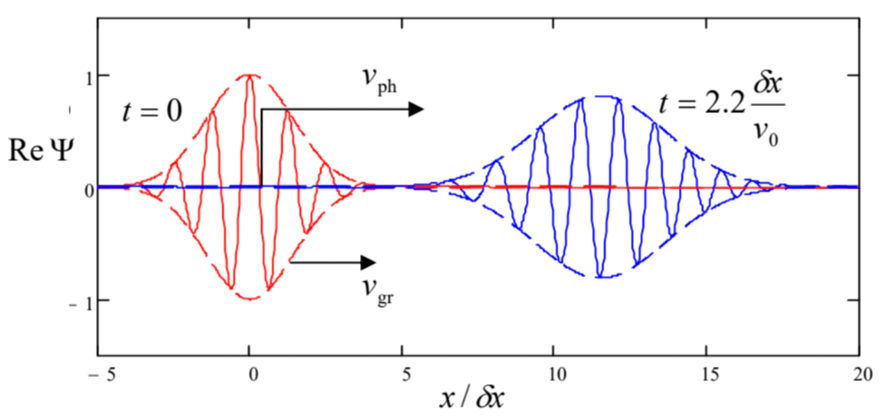

Fig. Evolución de la parte real de un paquete inicial de ondas en tiempos más cortos y más largos

Los gráficos muestran claramente los siguientes efectos:

(i) el paquete de ondas en su conjunto (caracterizado por su envolvente) se mueve a lo largo del eje x con una determinada velocidad de grupo,

(ii) la onda cuasi-sinusoidal «portadora» dentro del paquete se mueve con una velocidad de fase diferente, que puede definirse como la velocidad de los puntos espaciales donde la fase de la onda toma un valor fijo (por ejemplo, , donde se anula), y

(iii) el ancho espacial del paquete de ondas aumenta gradualmente con el tiempo: el paquete se expande.

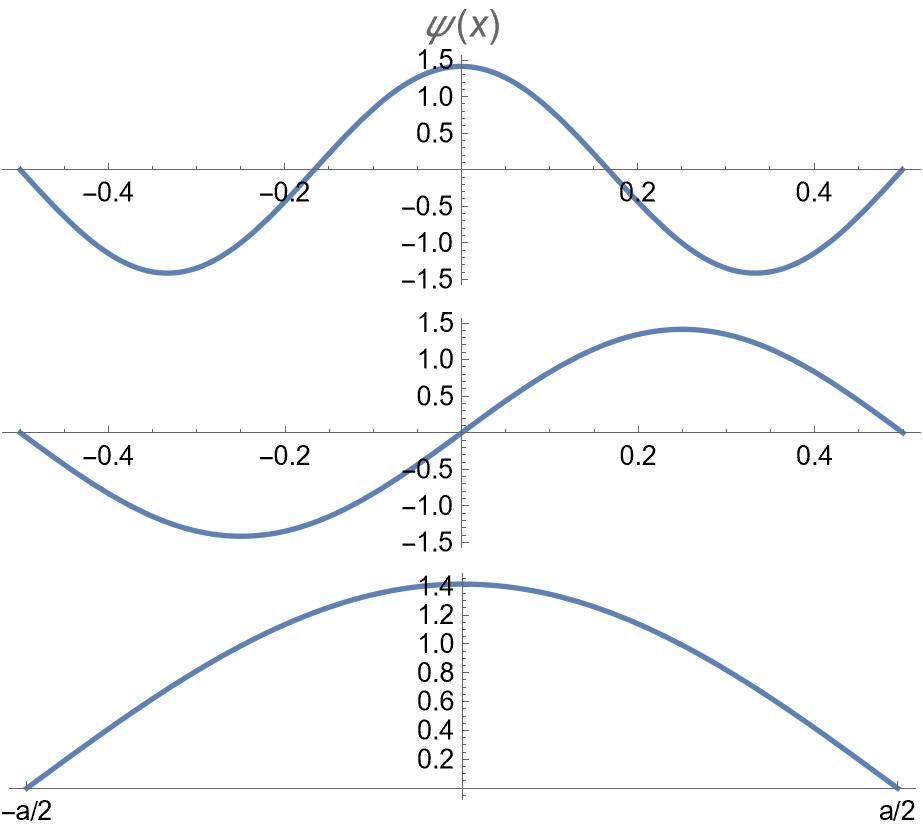

Partícula libre dentro de una caja

Una caja es una región cuyas fronteras tienen un potencial que crece instantáneamente hasta infinito (ec. 34):

En la región interna al pozo de potencial, la partícula no ve ninguna variación de potencial así que se comporta como la partícula libre que analizamos anteriormente. La solución general es una combinación de ondas viajeras que se mueven hacia x crecientes y hacia x decrecientes, y esa combinación debe cumplir las condiciones de contorno de que la función de ondas independiente del tiempo se anule en las fronteras.

Esto implica que combinaremos la misma proporción de ondas viajeras del mismo k hacia la derecha e izquierda, con el fin de obtener ondas estacionarias:

o bien:

Lo cual conduce a la solución general:

donde

para x entre -a/2 y a/2, con la condición de contorno:

en

. Esto es, la onda estacionaria tiene nodos en las paredes de la caja.

Mediante el uso de las condiciones de contorno se obtienen las condiciones a satisfacer por las constantes A, B y por el parámetro k. Las soluciones son (ecs. 35):

Y usando ahora la relación entre el número de ondas y la energía , obtenemos los autovalores de energía correspondientes:

En conclusión, la energía total de la partícula en la caja está cuantizada, y hay una energía mínima E1 que la partícula puede tener, no está permitido E=0. Esto está relacionado con el principio de incertidumbre: es necesario que haya un momento y por tanto una energía del punto cero porque la posición está indefinida: $\delta x \approx a$ y por tanto el momento también.

La figura siguiente muestra las tres primeras autofunciones del problema del pozo infinito.

Átomos con un electrón

El potencial (energía potencial) colombiano que afecta a un electrón es:

Donde x,y,z son las coordenadas rectangulares del electrón de carga -e respecto al núcleo que está fijo en el origen. La carga nuclear es +Ze. Según la mecánica clásica, el electrón de masa m orbitaría en torno al centro de masas del sistema electrón-núcleo, con una masa reducida de:

La ecuación de Schrödinger para este electrón sería (ec. 38):

Dado que el potencial no depende de t, es fácil ver que mediante el método de separación de variables se pueden obtener soluciones de la forma:

Donde la autofunción es una solución de la ecuación independiente del tiempo (ec. 40):

El problema con esta ecuación en coordenadas cartesianas es que no es resoluble con el método de la separación de variables, porque V(x,y,z) no se puede descomponer en el producto de una función de x, una función de y, y una función de z. En cambio, si escribimos el potencial en coordenadas esféricas, al ser un potencial central, es una función de una sola variable, la distancia radial r:

Esto sugiere la conveniencia de escribir toda la ecuación de Schrödinger en coordenadas esféricas:

donde:

El operador laplaciano se ha complicado, pero el cambio merece la pena, porque la ecuación ahora sí es separable. Probemos con soluciones del tipo:

Sustituyendo, obtenemos:

que se puede escribir como:

Dividiendo ahora por obtenemos:

que se puede escribir como:

Como el primer miembro de esta ecuación no depende ni de r ni de , mientras que el segundo no depende de

, su valor común no podrá depender de ninguna de estas variables, esto es, será una constante que por conveniencia se designará

. Obtenemos así:

y (ec. 46):

La elección de la notación se debe a que posteriormente se entendió que este valor real es el número cuántico magnético, que coincide con el autovalor del operador componente-z del momento angular. Reordenando términos obtenemos un miembro que sólo depende de r y otro que sólo depende de

(ec. 47):

Ambos términos de esta ecuación deben ser igual a la misma constante, que por conveniencia se suele escribir l(l+1).

y:

La razón de esta nomenclatura para la constante obedece a que la ecuación que se obtiene en la variable es la ecuación asociada de Legendre. Para que las soluciones sean finitas y bien definidas en los polos

la constante debe tomar la forma l(l+1) con l = 0, 1, 2,… En ese caso, las soluciones son polinomios asociados de Legendre, regulares en toda la esfera. Posteriormente a la resolución del problema por Schrödinger, se demostró que la parte angular del hamiltoniano coincide con el operador del momento angular total:

Es decir, es el autovalor de

o número cuántico orbital y escribir la constante así anticipa este resultado físico.

La resolución del problema de separación de variables ha quedado reducido así a la resolución de las tres ecuaciones diferenciales ordinarias (45), (48) y (49). Al resolver estas ecuaciones se encuentra que la ecuación tiene valores aceptables sólo para ciertos valores de . Usando estos valores

en la ecuación (48) resulta que esta ecuación tiene valores aceptables para ciertos valores de l. Con estos valores de l en la ecuación (49) se encuentra que ésta sólo tiene soluciones aceptables para ciertos valores de la energía total E, esto es, la energía del átomo está cuantizada.

Resolución de las ecuaciones para las tres funciones de variables esféricas

Empecemos con la ecuación para \phi. Por sustitución es fácil comprobar que tiene la solución particular:

Al ser una coordenada periódica, la función

debe satisfacer:

, es decir:

, o lo que es lo mismo:

Esta condición se satisface sólo si el valor absoluto de es un número natural:

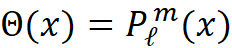

Resolver la ecuación para $\Theta(\theta)$ es un poco más complicado, y no lo haremos aquí. La clave para resolverla es hacer la sustitución , que convierte la ecuación en otra equivalente pero algebraica:

Es la ecuación de Legendre asociada, cuyas soluciones físicamente aceptables (regulares y normalizables en [-1, 1]) son los polinomios de Legendre asociados:

con:

Así que se encuentra que las únicas soluciones que permanecen finitas se obtienen sólo si la constante l es igual a uno de los enteros:

y son de la forma:

De manera que hacen falta los dos números cuánticos para obtener

Para resolver la ecuación diferencial de la parte radial, se tiene en cuenta que para la solución debe decaer exponencialmente y para

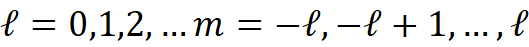

el término l(l+1)/r2 domina. Esto sugiere escribir:

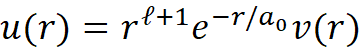

Al sustituir, la ecuación se convierte en una ecuación para v(r) que admite soluciones polinómicas. La ecuación para v(r) es una ecuación hipergeométrica que matemáticamente tiene soluciones generales infinitas y solo para ciertos valores discretos del parámetro (la energía) la serie se convierte en un polinomio. Esos valores son precisamente (ec. 54):

Que es la condición que cuantiza la energía. En esta expresión, el número cuántico n es uno de los enteros:

n = l+1, l+2, l+3,…

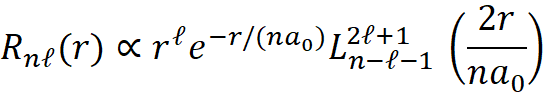

Las soluciones radiales son (ec. 55):

donde son polinomios de Laguerre asociados.

En resumen, hay tres números cuánticos, efecto de tener tres dimensiones espaciales, que están cuantizados, pudiendo tomar los valores:

Vemos que para cada valor de energía En (para cada n) hay autofunciones que tienen la misma energía.

La expresión (54) puede escribirse como:

Que coincide con las predicciones del modelo de Bohr. Esto convenció a la mayoría de físicos de la verosimilitud del modelo de Schrödinger.

Otro resultado importante fue comprobar que la ecuación que se obtiene para al separar variables en el problema del átomo de hidrógeno es la misma ecuación que se obtiene al calcular las autofunciones del operador

. Wolfgang Pauli, entre 1926 y 1927, fue de los primeros en notarlo.

Mucho antes de Schrödinger ya había físicos que entendieron que los niveles de energía del hidrógeno estaban degenerados, que el número cuántico n no bastaba para caracterizar unívocamente los estados,y que hacían falta más variables (más números cuánticos) para distinguir estados con la misma energía. Bohr tuvo en 1913 la primera intuición de esa degeneración. En su modelo del átomo de orbitales introdujo el número cuántico principal n y vio que la energía dependía solo de n, pero las órbitas podían tener distintas inclinaciones y orientaciones sin cambiar la energía.

Sommerfeld (1916) extendió el modelo de Bohr a órbitas elípticas. Para ello introdujo el número cuántico azimutal (l) y el número cuántico radial (nr), y propuso que para un mismo n había muchas órbitas distintas (de diferentes excentricidades y orientaciones) con la misma energía.

Fue Pauli (en 1926) quien entendió que el nivel n tiene degeneración n2 y que si dos operadores A y B actúan sucesivamente sobre un estado del átomo, el orden en que actúen cambia en general el resultado, de ahí que se defina el conmutador de dos operadores:

Pauli introdujo el momento angular como operador cuántico y reconoció que para caracterizar completamente un estado cuántico degenerado como el de la energía En, hace falta un conjunto de operadores que conmutan entre sí y cuyos autovalores etiqueten unívocamente los estados.

Paul Dirac (entre 1927 y 1930) estableció la formalización moderna para definir de forma unívoca el estado del átomo mediante un Conjunto Completo de Observables que Conmutan (CCOC). Entre 1927 y 1928 formuló explícitamente el momento angular como operador abstracto, definió y

y mostró que sus autofunciones son los armónicos esféricos. Con lo que dejó claro que resolver la ecuación angular de Schrödinger equivale a encontrar las autofunciones de

. Esta evidencia, surgida del problema del átomo de hidrógeno, reforzó también la idea de que los valores posibles de un observable son los autovalores del operador cuántico asociado.

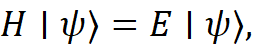

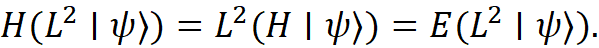

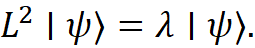

En formulación ondulatoria, un autovalor como la energía En aparece como degenerado porque hay varias (en este caso n2) autofunciones ortogonales entre sí que tienen el mismo autovalor En. Ahora bien, si un operador cuántico, como L2, conmuta con otro como H es fácil demostrar que ambos operadores tienen las mismas autofunciones para cada valor de n no degenerado (en nuestro caso, sólo n=1, o E1, es no degenerado). En efecto, si es el único estado (salvo una constante compleja, o sea, salvo la exponencial de una fase) con energía E, entonces:

y como [H, L2] = 0,

Esto significa que es otro autovector de H con el mismo autovalor E. Pero como el autovalor es no degenerado, ese vector debe ser proporcional a

:

Así que es autofunción de ambos.

Pero para los autovalores degenerados (n = 2, 3, etc.) es posible encontrar una base ortogonal de autofunciones de L2 que son también autofunciones de H. Si para n=2 (degeneración de la energía igual a 4) hubiera 4 autofunciones ortogonales de L2 que lo fueran también de H, los 4 autovalores de L2 junto con el valor n=2 bastarían para caracterizar unívocamente el estado del átomo con esa energía. Pero resulta que para n=2 encontramos sólo 2 autovalores de L2 ortogonales (l = 0 y l = 1) de los cuales el primero es unívoco (dimensión 1) pero el segundo tiene degeneración 3. Esto nos obliga a buscar un observable adicional que conmute con los dos anteriores, que suele ser Lz, cuyas tres autofunciones ortogonales correspondientes a los números cuánticos m=-1, m=0 y m=1 permiten volver unívocamente identificable el estado concreto de energía E2 en que puede estar el átomo. Ese conjunto de tres operadores E, L2 y Lz forman un CCOC.

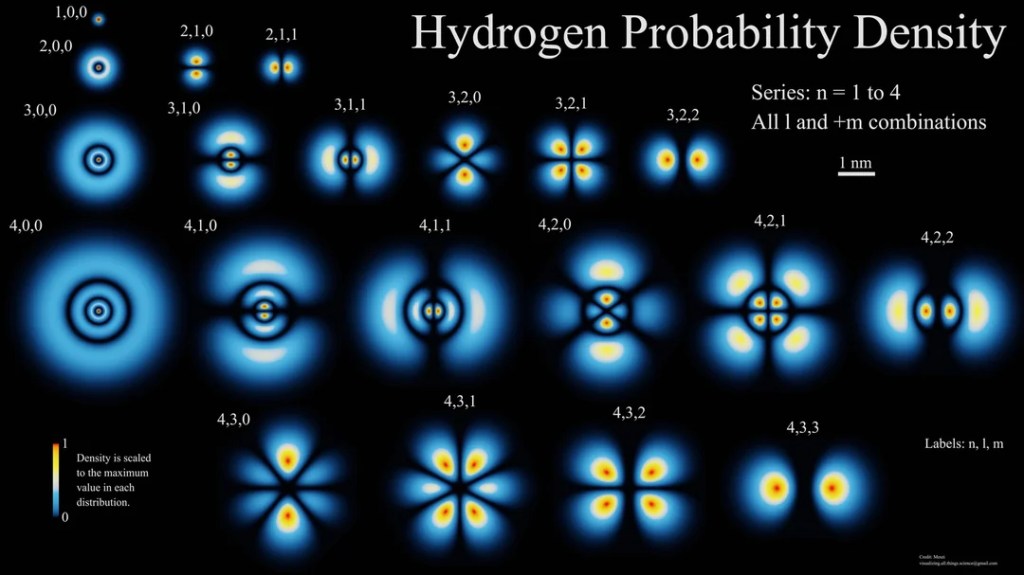

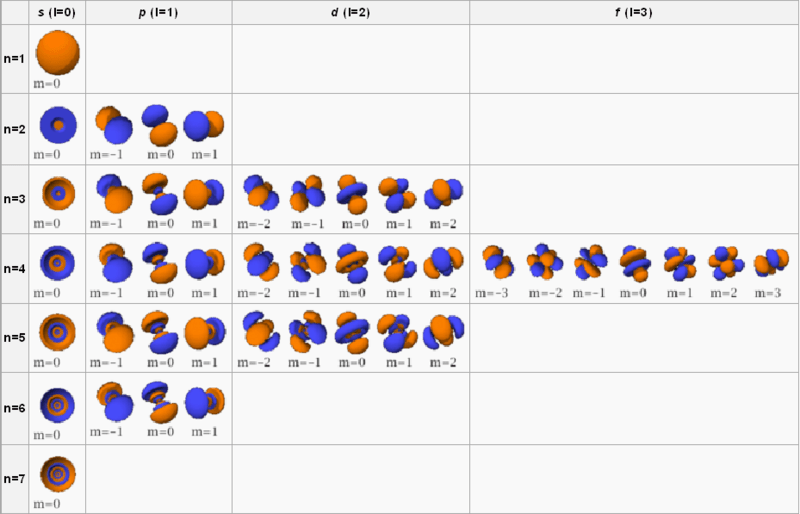

Las figuras siguientes muestran un corte plano y una recreación 3-D de las densidades de probabilidad de encontrar al electrón en cada punto del espacio para los primeros números orbitales .

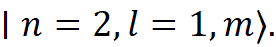

Observemos el estado (n=3,; l=2,; m=0) de la figura, que está alineado con mayor probabilidad a lo largo de un eje, generalmente tomado como el eje Z. ¿Es un estado como este físicamente distinguible? Si sabemos que el electrón está en este estado, sabemos que está probablemente cerca del eje OZ, y esto resulta paradójico porque la ecuación de Schrödinger no privilegia ninguna dirección espacial, el eje Z ha sido elegido arbitrariamente para resolver el problema de separación de variables en coordenadas esféricas.

La paradoja se resuelve si entendemos qué significa “medir m”. Los números cuánticos n (energía), l (momento angular total) y m (proyección del momento angular sobre un eje elegido) corresponden a autovalores de los operadores observables y

respectivamente, si hemos elegido el eje OZ para observar. Por tanto, en principio se pueden medir

.

Si hacemos esas tres medidas y obtenemos:

- Energía -1,51 eV (correspondiente a

para n=3)

, correspondiente a

con l = 2

, correspondiente a m = 0,

entonces hemos proyectado el átomo al estado .

Esto se debe a que medir Lz depende del eje elegido en el experimento, porque m es un número relativo a un eje arbitrario que nuestro aparato de medida define.

En ausencia de cualquier campo externo, no hay forma de distinguir experimentalmente entre los distintos valores de m, porque todos los estados con el mismo n y l son degenerados, esto es, tienen la misma energía. La forma de medir (y a la vez preparar) que el estado estará en m = 0 es aplicando un campo magnético (efecto Zeeman). Entonces el Hamiltoniano adquiere un término

Esto rompe la degeneración entre los distintos m, porque:

Entonces cada valor de m produce una energía distinta, podemos medir esas energías espectroscópicamente e identificar el valor de m. Sin campo externo, no hay forma de distinguirlos.

Si ahora seleccionamos átomos con m=0 visible, estamos preparando átomos en ese estado. Pero si quitamos el campo, el estado sigue siendo respecto al eje OZ que el aparato de medida definió. No hay nada en la física que lo haga “girar” o “perder” esa orientación.

Si sólo hemos medido E (o sea, n) y (o sea l), lo único que sabemos del átomo es que, si no ha interaccionado con nada, está en una combinación lineal desconocida de las infinitas posibles entre las cinco autofunciones de

. Los coeficientes de esa combinación serán desconocidos (dependerán del estado inicial en el que se encontraba el sistema antes de cualquier proyección) y por tanto el valor esperado del observable no será calculable a priori.

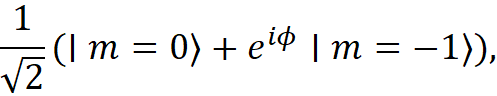

También es posible en principio preparar al sistema en una superposición con amplitudes bien conocidas de dos autofunciones distintas, por ejemplo, un átomo con n y l bien determinados pero el número m pudiendo tomar dos valores distintos. Pero preparar una superposición no consiste en medir para proyectar el sistema, sino en:

- partir de un estado bien definido,

- aplicar una interacción externa controlada,

- que acople selectivamente los estados deseados,

- con amplitud, fase y duración conocidas.

El resultado es una evolución unitaria que construye la superposición.

Tomemos el caso concreto de un subespacio degenerado y supongamos que el átomo está inicialmente en un estado conocido, por ejemplo

Los estados con distintos m son degenerados, pero pueden acoplarse mediante campos externos que rompen la simetría esférica. Una herramienta experimental clave para ello son los campos electromagnéticos coherentes. Se usan campos externos con propiedades bien controladas:

- campo magnético (efecto Zeeman),

- campo eléctrico (efecto Stark),

- radiación electromagnética polarizada.

Por ejemplo:

- un campo magnético transversal acopla estados con

,

- la polarización del campo fija qué transiciones se activan,

- la fase del campo fija la fase relativa de la superposición.

Los coeficientes cm también pueden ser fijados, porque la duración del pulso fija las amplitudes relativas. Estos procedimientos son rutina en espectroscopía coherente, control cuántico, trampas de iones, y átomos fríos. Y permiten preparar superposiciones concretas. Por ejemplo, un pulso ajustado a media oscilación produce:

con completamente controlable.

El conocimiento de la forma del Hamiltoniano externo, el tiempo de interacción, y la fase del campo, permiten calcular exactamente el estado final.

Todo esto funciona solo mientras el sistema esté suficientemente aislado. En cuanto el átomo colisiona, emite radiación espontánea, o interactúa con campos fluctuantes, la superposición coherente entre los distintos m se pierde como estado del átomo. Analizaremos el tema de la decoherencia al final del artículo.

El formalismo de Dirac y los axiomas de la Mecánica Cuántica

El primer paso importante que hizo Dirac fue distinguir entre el estado del sistema y su función de ondas. Para Dirac, la función de ondas se puede considerar como el conjunto de componentes del estado del sistema

en una base particular que es r, las posiciones posibles. El estado del sistema se representa mediante un “ket”, que es ese símbolo

. Se define un producto escalar

entre dos kets, que sea lineal respecto al segundo elemento, antilineal respecto al primero y que cumpla la propiedad:

El espacio de los kets con este producto escalar es un espacio vectorial . Luego tenemos el espacio dual del anterior, llamado

. Se trata de un espacio vectorial generalizado que a todo ket

le asocia un número complejo, que es el resultado del producto escalar (|\phi\rangle, |\psi\rangle), y la notación es:

Este símbolo se suele llamar “bracket”. Los bra designan funcionales lineales actuando sobre los kets.

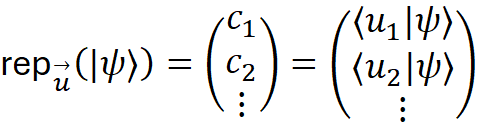

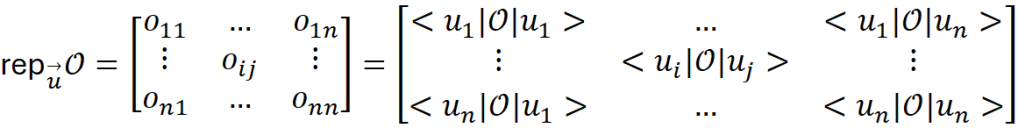

En una base , el estado del sistema se puede representar de las siguientes formas vectoriales:

- Forma ket:

2. Forma bra:

donde el asterisco significa «complejo conjugado».

Un operador puede actuar sobre kets y sobre bras. Al actuar sobre los kets obedecen a las reglas conocidas de los operadores en espacios de Hilbert tradicionales. Al actuar sobre los bras, el operador A asocia a todo bra un nuevo bra: . La acción de A sobre los bra es lineal.

La acción de un operador sobre un estado en una representación dada es una matriz cuyos “elementos de matriz” son números complejos de la forma siguiente:

Donde el objeto representa el producto escalar generalizado entre el bra y el ket

.

En la misma base unitaria la representación de un operador observable O se define mediante la matriz:

En dimensión finita, los autovalores se encuentran diagonalizando el representante del operador: igualando a cero el siguiente determinante:

. Y los autovectores se calculan resolviendo el sistema de n ecuaciones:

para todo i entre 1 y n.

Los axiomas de la Mecánica Cuántica en la formulación de Dirac y Von Neumann son básicamente los siguientes:

1 El estado del sistema es un ket .

2 Los observables son operadores hermíticos.

3 La medida proyecta el estado sobre un autovector.

4 El valor esperado es .

5 La evolución temporal sigue la ecuación de Schrödinger.

Para una descripción didáctica se puede consultar Postulados de la mecánica cuántica – Wikipedia, la enciclopedia libre, y para una discusión más detallada en notación de Dirac, el libro Cohen-Tannoudji (ver referencias al final).

La estadística cuántica

Las variables dinámicas representadas por los observables de un CCOC pueden ser definidas todas ellas con precisión y forman un conjunto completo de variables compatibles. Si se realiza simultáneamente la medida precisa de los valores tomados por estas variables se está seguro de que la función de ondas del sistema es una función propia de todos los observables que componen el CCOC, y esa función de onda estará unívocamente asociada a los observables a, b, c… hallados en la operación de medida. Como sólo existe una función de onda que posea esta propiedad (salvo una constante o fase sin significado físico), dadas estas medidas queda completamente definida la función de onda del sistema físico.

Una vez terminada esta preparación en un tiempo t0, la función de onda evoluciona en el tiempo siguiendo la ecuación de Schrödinger, y mientras no haya interacciones con otros sistemas, nuestro sistema tendrá un estado perfectamente conocido. Nuestro sistema se dice que está en un estado dinámico puro.

Pero en la práctica, una preparación completa como la citada se realiza raras veces. Lo más frecuente es que las variables medidas durante la preparación no formen un CCOC, luego el estado dinámico del sistema no se conoce exactamente. En este caso, hay que recurrir a los métodos de la estadística. En lugar de un estado bien determinado se trata de una mezcla estadística de estados, caracterizada por una mezcla estadística de funciones de onda caracterizadas cada una de ellas por pesos estadísticos determinados p1, p2,…,pk con $\sum_k=1$.

En las predicciones realizadas sobre una mezcla, la estadística interviene doblemente. Primero, por razones puramente cuánticas ligadas a la operación de medida, que proyecta con cierta probabilidad la función de ondas pura inicial sobre los autovalores del observable u observables que estamos midiendo; en segundo lugar, porque el estado dinámico del sistema no se conoce completamente.

Aplicando la definición de valor medio de un observable no a una función de onda pura sino a esa mezcla con pesos pk obtenemos que para cierto tiempo t:

Donde:

O en notación de Dirac y con vectores normalizados a la unidad:

Análogamente, si es la probabilidad de encontrar el resultado ai cuando el estado dinámico del sistema es

, la probabilidad de encontrar este resultado cuando se realiza la misma medida sobre la mezcla en el instante t es:

Un caso muy importante de mezcla estadística es el de un sistema en equilibrio termodinámico con un termostato de temperatura T. Los distintos estados dinámicos posibles son los estados propios del hamiltoniano H del sistema. Se supone que el peso estadístico que corresponde a un estado propio i de H depende sólo del autovalor asociado, en la forma:

donde K es la constante de Boltzmann.

En situaciones como esta en que el estado del sistema sólo podemos caracterizarlo como una mezcla, los axiomas de la mecánica cuántica deben ser generalizados a conjuntos estadísticos a través de un operador de densidad estadística. Esto fue realizado independientemente por John von Neumann y Lev Landau en 1927. Landau introduce la matriz densidad para describir sistemas cuánticos en equilibrio térmico, donde los estados puros no bastan. Su motivación fue unir la Mecánica Cuántica con la termodinámica.

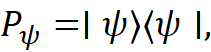

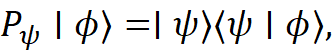

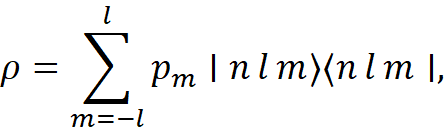

Von Neumann adopta las ideas de Landau sobre estados mixtos y lo introduce en su formulación axiomática de 1932 utilizando los operadores de proyección. Lo hace a través de un operador muy útil llamado operador densidad (u operador estadístico):

En esta expresión las son pesos estadísticos y los vectores del estado están normalizados a la unidad pero no son necesariamente ortogonales. Este operador densidad es una mezcla estadísticamente pesada (que asigna pesos pk a los estados posibles

) de operadores proyección sobre el subespacio del vector

.

Si es un estado normalizado y definimos el operador

entonces, al actuar sobre cualquier estado ,

el resultado es la componente de en la dirección de

. La interpretación geométrica es clara. En el espacio de Hilbert,

es el “coeficiente de proyección” (un número complejo);

es un vector colineal con

; y su norma es

. Es exactamente el análogo cuántico de proyectar un vector sobre una dirección fija en un espacio vectorial ordinario. Si

es, por ejemplo,

entonces es el proyector sobre esa superposición concreta, no sobre un valor de m. Si

forma parte de un conjunto de proyectores que definen una medición, la probabilidad de obtener el resultado asociado a

es:

y el estado posterior (condicionado a ese resultado) es precisamente

Que es la regla de proyección estándar en Mecánica Cuántica cuando se mide una magnitud que tiene asociada una autofunción .

El operador densidad es muy apropiado para operar con estados mezclados (o mixtos) porque contiene toda la información necesaria para calcular todas las cantidades físicamente medibles, valores medios y distribuciones estadísticas de las medidas. Por ejemplo, se puede demostrar que:

El valor medio de cualquier función del observable A:

Si PD es el proyector sobre el subespacio de los vectores propios de A de valores propios situados en cierto dominio D del espectro de A, la probabilidad de que la medida pertenezca al dominio D es

, o lo que es lo mismo:

En particular, la probabilidad de que el sistema se encuentre en el estado de norma 1 es:

Y la evolución de la mezcla estadística a lo largo del tiempo viene dada por:

En mecánica estadística clásica, el ensemble o densidad de estados en un punto del espacio de fases es una cantidad real positiva cuya integral extendida a todo el espacio de fases es igual a 1 (véase Entropía, irreversibilidad y flecha del tiempo según Gibbs). En mecánica cuántica,

es un operador hermítico cuyos valores propios son todos positivos y cuya traza es igual a 1. La evolución de la densidad clásica a lo largo del tiempo viene dada por:

es decir, se pasa de las expresiones de la teoría clásica a la cuántica sustituyendo las magnitudes ordinarias por observables, los corchetes de Poisson por conmutadores (salvo un factor ) y la integración extendida a todo el espacio de fases por la traza. Esta nueva formulación del principio de correspondencia resulta muy útil cuando se quiere extender al dominio cuántico los resultados principales de la termodinámica estadística clásica. Por ejemplo, la expresión para la entropía de un sistema según estas correspondencias, viene dado por el valor medio del operador -K ln p o, dicho de otro modo:

que es similar a la entropía de Gibbs (Entropía, irreversibilidad y flecha del tiempo según Gibbs) salvo que la integral a todo el espacio de fases ha sido sustituida por la traza.

La decoherencia

Retomemos ahora la situación del átomo de hidrógeno analizado anteriormente en el que hemos medido simultáneamente los números cuánticos (n, l, m) y tenemos el estado del átomo perfectamente conocido; o bien hemos medido solamente E (o sea, n) y (o sea l), o bien hemos dejado el átomo preparado en un estado de superposición bien definido, cualquier estado puro que se nos ocurra. El que el átomo interaccione con otros átomos antes de que volvamos a medir, influye en algo en ese estado en el que lo habíamos dejado? La respuesta es que sí influye, y mucho.

Antes de la interacción tenemos una ignorancia epistémica. Si sólo medimos L2 y Lz hay una superposición entre las autofunciones con distintas m, no sabemos cuales son los cm de la superposición, pero el sistema puede seguir en el estado puro de superposición en el que lo preparamos si lo hemos aislado rigurosamente.