Durante el siglo XIX, aunque la teoría atómica de John Dalton ganaba terreno, el atomismo no era aceptado de forma universal. Muchos científicos consideraban la existencia de átomos como una hipótesis especulativa, innecesaria o incluso filosóficamente errónea.

La alternativa principal y más influyente fue el Energetismo, junto con otras visiones basadas en la continuidad de la materia.

El Energetismo (Energética)

Esta fue la crítica más fuerte y sistemática al atomismo a finales del siglo XIX. Sus defensores argumentaban que la materia es solo una manifestación de la energía, la cual es la única realidad física fundamental.

Sostenían que las leyes de la termodinámica (especialmente el principio de conservación de la energía, y la Segunda Ley) bastaban para explicar todos los fenómenos físicos y químicos sin necesidad de invocar partículas invisibles.

Esto fue defendido por científicos como Wilhelm Ostwald, químico ganador del Nobel que, durante gran parte de su carrera, rechazó la existencia de átomos, argumentando que eran innecesarios para la química.

También por Pierre Duhem, físico francés que propuso que toda la física y química podían derivarse de los principios termodinámicos, evitando modelos corpusculares. La física construye estructuras matemáticas que organizan fenómenos; no es necesario atribuir existencia ontológica a los átomos. Duhem defendió que las teorías físicas son instrumentos para describir y ordenar hechos experimentales y que la física busca la expresión más simple y económica de los datos, por lo que hablar de átomos como realidades últimas no es requisito epistemológico.

También lo defendió Ernst Mach, físico y filósofo que rechazaba cualquier concepto científico que no fuera directamente observable (como los átomos), prefiriendo una visión basada en la «economía del pensamiento» y la descripción de sensaciones o fenómenos medibles. Para Mach los átomos son hipótesis útiles, no entidades metafísicas; la ciencia debe limitarse a lo observable y a la economía conceptual. Mach sostuvo que los conceptos teóricos deben evaluarse por su capacidad para economizar la experiencia; si el átomo no aporta observables directos, su estatus ontológico queda en suspenso y su uso es pragmático.

El Continuismo (Teorías de campo y fluidos)

Muchos científicos del siglo XIX heredaron la visión de la física clásica donde la naturaleza es esencialmente continua (natura non facit saltus o «la naturaleza no da saltos»). En lugar de ver la materia como granos discretos (átomos) separados por vacío, algunos preferían verla como un medio continuo, similar a un fluido, que llena el espacio.

Aunque no era una teoría de la materia directamente, muchos físicos creían que el éter luminífero era la sustancia más fundamental del universo, y que la materia ordinaria era una perturbación o condensación de él. Justificación: Las ecuaciones de Maxwell para el electromagnetismo parecían requerir un medio de propagación. Era difícil imaginar ondas sin una sustancia que ondulara, en este caso, un éter fluido muy difícil de observar pero que tenía que llenar todo el espacio.

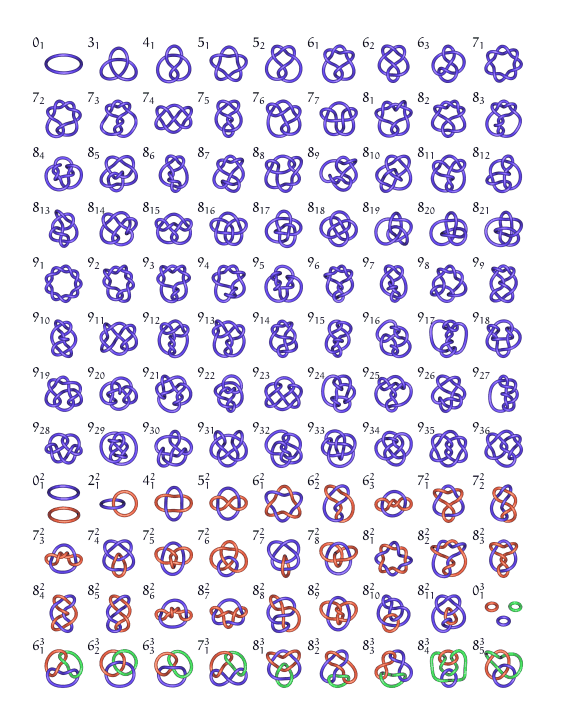

La Teoría de los vórtices (vortex theory), propuesta por Lord Kelvin (William Thomson) en 1867, fue muy popular en la física británica durante décadas. La idea era que los átomos no son partículas sólidas sino nudos de vórtices estables en el éter. Distintos tipos de átomos serían distintas configuraciones topológicas de estos vórtices.

La idea se le ocurrió a Thomson tras observar los experimentos que el físico-matemático Peter Tait estaba realizando con anillos de humo que, a su vez, se inspiraban en un artículo de Helmholtz sobre los anillos de vórtices en fluidos incompresibles. Thomson y Tait llegaron al convencimiento de que el estudio y la clasificación de todos los nudos posibles explicaría por qué los átomos absorbían y emitían luz en frecuencias determinadas.

Fig. Nudos de Tait. Se habrían convertido en la base de la Tabla Periódica si la teoría de Kelvin hubiera resultado correcta

La teoría era matemáticamente elegante. Helmholtz había demostrado que los vórtices en un fluido ideal son eternos y estables, lo que explicaría por qué los átomos no se destruyen. También prometía unificar materia y éter en una sola sustancia. Inspiró incluso los primeros trabajos de teoría de nudos en matemáticas. Sin embargo, la teoría no pudo explicar la gran diversidad de observaciones que se fueron acumulando a lo largo de los años sobre el comportamiento de la materia.

La visión fenomenológica (Química sin átomos)

Durante gran parte del siglo XIX, muchos químicos adoptaron una postura pragmática: utilizaban las fórmulas químicas (como ) como herramientas heurísticas (útiles para calcular) pero no necesariamente como una descripción literal de la realidad. Muchos investigadores sentían que, dado que nadie había «visto» un átomo, era científicamente más honesto quedarse con las leyes de las proporciones definidas y las relaciones de peso, sin hacer afirmaciones metafísicas sobre la estructura de la materia.

Para muchos químicos prácticos, el atomismo era irrelevante para el trabajo de laboratorio diario, donde las transformaciones de energía y masa eran lo único cuantificable y real. Los escépticos no eran irracionales: en ausencia de evidencia directa, exigir observabilidad era una postura filosófica legítima.

¿Por qué estas teorías perdieron fuerza?

Las leyes de proporciones definidas y múltiples de las reacciones químicas se habían convertido en una evidencia experimental sólida durante el s. XVIII:

- Ley de conservación de la masa (1789): Enunciada por Antoine Lavoisier, establece que la materia no se crea ni se destruye en una reacción química.

- Ley de las proporciones definidas (1799): Formulada por Joseph Louis Proust, indica que los elementos se combinan para formar compuestos en proporciones de masa fijas.

- Ley de las proporciones recíprocas (1792): Introducida por Jeremias Benjamin Richter, quien además acuñó el término «estequiometría».

- Ley de las proporciones múltiples (1803): Propuesta por el propio John Dalton, señala que si dos elementos forman varios compuestos, las masas de uno que se combinan con una masa fija del otro mantienen relaciones de números enteros sencillos. [1, 2, 3, 4, 5, 6, 7]

Para explicar tales evidencias John Dalton presentó la teoría de que la materia estaba constituída por átomos de distinto peso. En 1803 expuso sus primeras ideas y una tabla de pesos atómicos ante la Sociedad Literaria y Filosófica de Manchester; y en 1808 publicó la primera parte de su obra fundamental, Nuevo sistema de filosofía química, donde formalizó sus postulados sobre los átomos como esferas indivisibles e idénticas para cada elemento químico. [1, 2, 3, 4, 5]

La clasificación de pesos atómicos de Dalton fue corregida por Stanislao Cannizzaro en 1858, en su artículo Sunto di un corso di filosofia chimica. Este trabajo reorganiza la química usando la ley de Avogadro, masas moleculares coherentes, y un sistema uniforme de pesos atómicosmás preciso que el de Dalton. En el Congreso de Karlsruhe (1860), Cannizzaro distribuye su folleto. Dmitri Mendeléiev lo leyó allí y lo cita como la clave que le permitió ordenar los elementos.

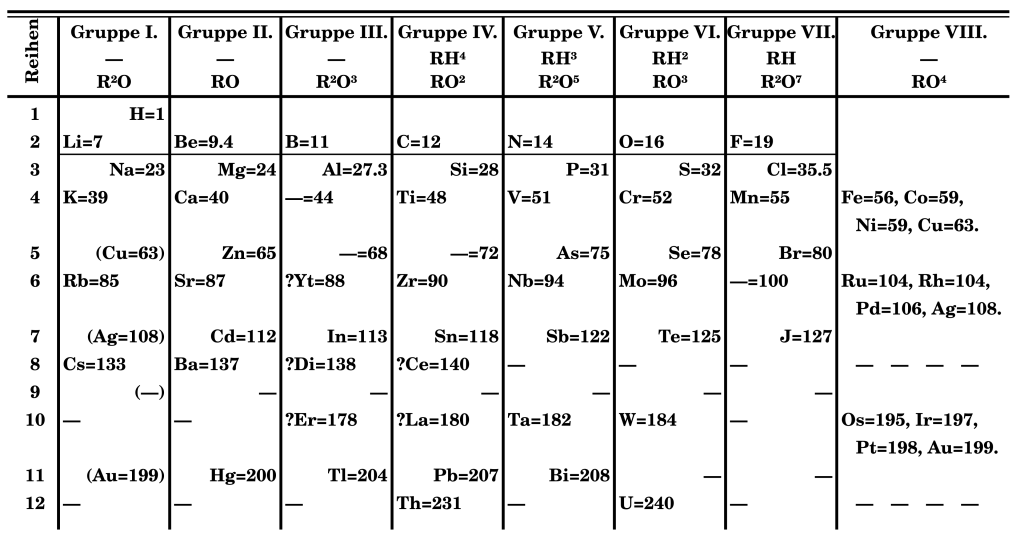

En 1869 Mendeléiev publica su artículo Relación de las propiedades con los pesos atómicos de los elementos. Se basaba en el concepto de Dalton de que hay átomos y los elementos químicos tienen pesos atómicos distintos, y en las correcciones de Cannizzaro. Al principio, no llamó mucho la atención.

Mendeléieven había dejado huecos de peso atómico en su tabla para elementos que no se conocían y que etiquetó con el prefijo sánscrito «eka» más el nombre de su elemento vecino. Por afinidad al grupo al que pertenecían, Mendeleiév había deducido qué propiedades químicas debían de tener esos elemntos desconocidos (densidad, color, punto de fusión, electronegatividad, tipo de óxido). Pues bien, en 1874 se descubrió un elemento, al que se denominó galio y que enseguida Mendeléyev hizo notar que las propiedades de dicho elemento se correspondían en gran medida con las predichas para el eka-aluminio en su tabla. En 1879, Lars F. Nilson descubrió el escandio y Per Theodor Cleve demostró que se trataba del eka-boro, otro de los elementos predichos. Por último, en 1885, Clemens A. Winkler aisló el germanio y el mismo Winkler demostró que se trataba del eka-silicio.[7][8]Tras estas demostraciones, la tabla periódica de Mendeléiev fue aceptada de forma casi unánime.

Fig. Segunda Tabla Periódica de los Elementos de Mendeléiev (1871). Está formada por ocho grupos verticales, según las proporciones en que los elementos se combinan con el oxígeno. (R representa cada elemento, O el oxígeno y los superíndices las proporciones atómicas, según la costumbre de la época)

Además, si un elemento no encajaba en su periodicidad, Mendeléiev asumía que el peso medido estaba mal; y acertó varias veces. La teoría parecía demasiado buena para rechazarla. Incluso si no se aceptaba la existencia de átomos, la tabla obligaba a admitir que: (i) los elementos no eran arbitrarios, (ii) había una arquitectura subyacente, y (iii) y la química tenía una regularidad profunda.

La interpretación más sencilla de todo esto era admitir la existencia de átomos, y Mendeleiev así lo creía. Pero la física dominante (Mach, Ostwald) era antiatomista, y la química podía funcionar perfectamente con átomos entendidos como ficciones útiles.

Mendeléiev creía que la química debía basarse en hechos experimentales no en hipótesis especulativas y no quería que su ley periódica dependiera de una hipótesis controvertida. Por eso escribió que la ley periódica “no depende de ninguna teoría sobre la constitución última de la materia”.

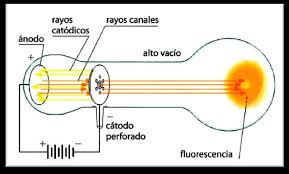

Los rayos catódicos y los rayos canales

Otra evidencia clave para la teoría discreta (atómica) de la materia surgió del estudio de los rayos catódicos. A finales del XIX, numerosos físicos estudiaron las descargas eléctricas en gases a baja presión, observando los rayos que salen del cátodo al ánodo cuando se eleva mucho la diferencia de potencial entre ambas placas. Se denominaron rayos catódicos.

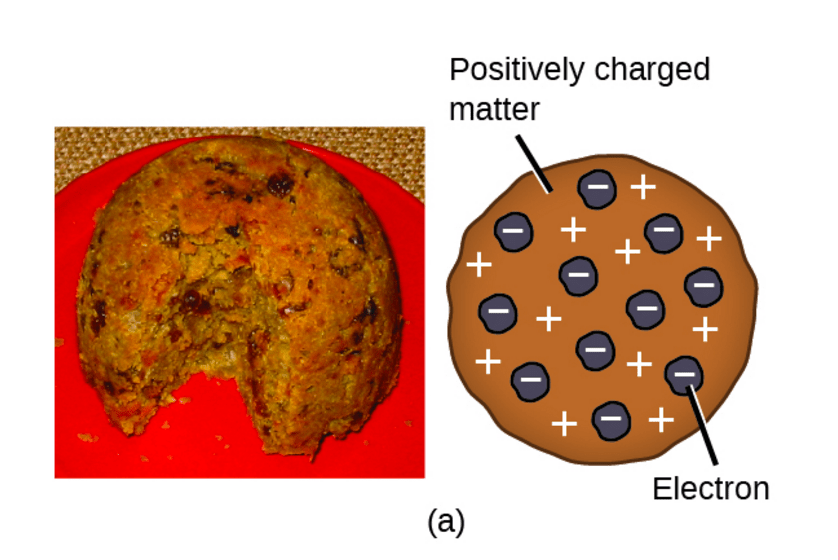

Thomson aplicó campos eléctricos e imanes a esos rayos catódicos. Observó que los rayos se desviaban siempre hacia la placa positiva, lo que sugería que estaban formados por partículas con carga negativa.

Al medir cuánto se desviaban las partículas, calculó su relación carga/masa. Descubrió que esta relación era siempre la misma, sin importar qué gas hubiera dentro del tubo o de qué material estuvieran hechos los electrodos. Esto sugería la existencia de una partícula de carga negativa presente en todos los metales y materiales conductores.

En 1897 Thomson afirmó que estas partículas, a las que llamó «corpúsculos» (posteriormente, electrones), eran componentes universales de todos los átomos y que eran aproximadamente 2000 veces más ligeras que el átomo de hidrógeno.

Pero esto sugería a su vez la existencia de partículas de carga positiva que mantuvieran la neutralidad de carga de la materia. Por este motivo, J.J. Thomson formuló pocos años después la teoría de que la materia estaba constituida por átomos, y que estos átomos consistían a su vez de partículas de carga negativa y de algo positivo que la compensara, para que el átomo fuera eléctricamente neutro. [1, 2] Propuso en 1904 su famoso «Modelo del budín de pasas» (Plum Pudding Model), donde imaginaba al átomo como una esfera de carga positiva (la masa del pastel) con los electrones incrustados (las pasas).

Fig. Modelo del Búdin de Pasas de Thompson para el átomo

Ya antes de 1897 Eugen Goldstein había observado los «rayos canales» que acompañan a los rayos catódicos en sus descargas, pero no los entendía completamente. Los rayos catódicos salían del polo negativo (cátodo). Pero los rayos canales aparecían en el lado opuesto y parecían dirigirse hacia el polo negativo, pasando por los agujeros del cátodo.

Dependiendo del gas en el tubo, los rayos canales emitían colores distintos, mientras que los rayos catódicos solían producir un resplandor verdoso constante al chocar con el vidrio. Además, los rayos catódicos eran mucho más «ligeros» y fáciles de desviar con imanes. Los rayos canales eran mucho más difíciles de desviar de su trayectoria recta.

Muchos científicos (especialmente los alemanes) pensaban que ambos eran ondas en el éter, como la luz. Otros pensaban que eran partículas. Pero tras el descubrimiento del electrón por Thomson, la interpretación de los rayos canales de Goldstein cambió por completo.

Tras conocer que Thomson había descubierto el electrón, Wilhelm Wien fue el primero en demostrar (en 1898) que los rayos canales tenían carga positiva y que su relación carga/masa e/m era muchísimo menor que la de los electrones. Probó que se trataba de partículas masivas (átomos con carga), no de ondas.

Aunque Wien identificó que eran partículas del gas, fue la comunidad científica, influenciada por los trabajos de Thomson y Townsend, la que articuló la idea de la ionización por colisión. Al saber que los rayos catódicos eran electrones (gracias a Thomson en 1897), resultó lógico deducir que estos electrones golpeaban los átomos del gas, arrancándoles un electrón y dejando un ion positivo que salía disparado en dirección opuesta.

La confirmación de Thomson se produjo entre 1907 y 1913: Thomson perfeccionó los experimentos de Wien usando campos eléctricos y magnéticos paralelos (su famoso espectrógrafo de parábolas). Con esto, no solo confirmó que eran iones del gas, sino que descubrió que un mismo elemento podía tener átomos de diferentes masas, lo que llevó al descubrimiento de los isótopos.

- Se comprendió que los electrones que viajaban hacia el ánodo chocaban con los átomos del gas residual dentro del tubo de descarga.

- Esos choques «arrancaban» electrones de los átomos neutros, convirtiéndolos en iones positivos (átomos con falta de electrones).

- Al tener carga positiva, estos iones eran atraídos violentamente hacia el cátodo negativo. Pero una fracción de ellos lograban pasar por los agujeros o «canales» del cátodo siguiendo líneas de campo eléctrico entre el potencial positivo del ánodo al potencial nulo de las paredes del tubo contenedor (conectadas a tierra). Estos eran los rayos que Goldstein había visto.

- A diferencia del electrón (que siempre es igual), se dieron cuenta de que la masa de las partículas de los rayos canales dependía del gas que hubiera dentro del tubo. Si había hidrógeno, las partículas eran ligeras; si había aire o neón, eran mucho más pesadas.

Finalmente, Rutherford identificó al rayo canal del hidrógeno como la unidad fundamental de carga positiva: el protón.

La teoría cinética de Maxwell y Boltzmann

James Clerk Maxwell, el mismo que formuló las cuatro ecuaciones del electromagnetismo, estaba convencido de que las leyes macroscópicas se originan de dinámicas microscópicas, y era un ferviente partidario de la teoría atómica de la materia. Entre 1860 y 1867, Maxwell fue el primero en calcular propiedades macroscópicas (como la presión, la difusión, la conducción térmica y la viscosidad) directamente desde la hipótesis del movimiento molecular.

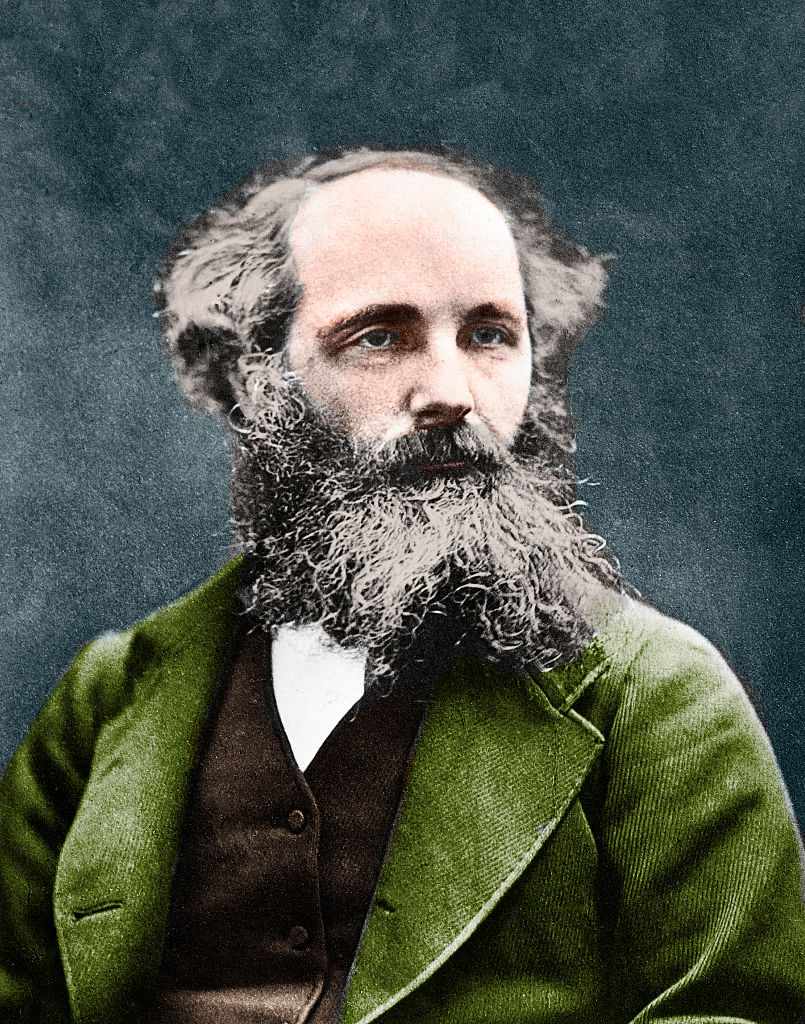

Imagen. James Clerk Maxwell (1831-1879)

Demostró teóricamente que la viscosidad de un gas es independiente de su densidad (presión), un resultado que luego verificó experimentalmente y que dejó asombrada a la comunidad científica de la época.

En su artículo de 1960 «Illustrations of the Dynamical Theory of Gases», Maxwell demostró que las velocidades siguen una distribución estadística (una campana de Gauss modificada). Estableció que la probabilidad de que una molécula tenga una velocidad específica depende de la temperatura y de su masa:

El Concepto de Camino Libre Medio había sido introducido por Clausius, pero Maxwell le dio rigor matemático en 1860 al calcularlo en función del diámetro d de las moléculas y la densidad n:

En 1867, en su segundo gran artículo, «On the Dynamical Theory of Gases», perfeccionó su teoría utilizando un enfoque basado en las colisiones binarias entre moléculas, e introdujo el concepto de operador de colisión, que sentó las bases para lo que más tarde sería la Ecuación de Boltzmann.

Maxwell se centró en las velocidades de las moléculas de un gas ideal. Boltzmann generalizó esto a cualquier sistema (sólidos, líquidos, gases con fuerzas intermoleculares) y a cualquier forma de energía E. Estableció que la probabilidad de que un sistema esté en un estado con energía E es proporcional al factor de peso estadístico:

La formulación estadística de las velocidades moleculares (la distribución de Maxwell y su extensión por Boltzmann) produjo predicciones cuantitativas comprobables sobre propiedades macroscópicas (conductividad, viscosidad, capacidad calorífica en ciertos regímenes), lo que reforzó la plausibilidad de un substrato atómico.

La formulación estadística de las velocidades moleculares (la distribución de Maxwell y su extensión por Boltzmann) produjo predicciones cuantitativas comprobables sobre propiedades macroscópicas (conductividad, viscosidad, capacidad calorífica en ciertos regímenes), lo que reforzó la plausibilidad de un substrato atómico.

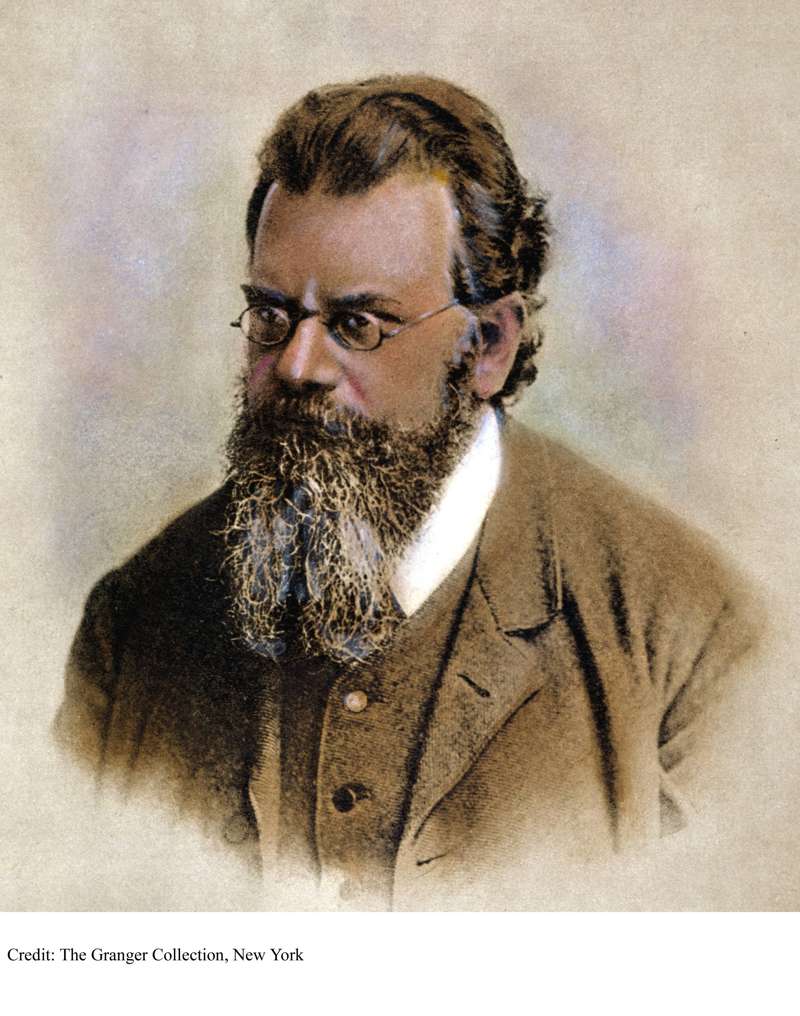

Entre 1866 y 1898 Boltzmann contribuyó al desarrollo de la Teoría Cinética, vinculó el concepto de entropía con la probabilidad estadística de configuraciones microscópicas, y formuló el teorema H como argumento de cómo surge la irreversibilidad macroscópica desde dinámicas microscópicas reversibles. Para él, esto hacía al atomismo no solo útil sino necesario para entender la termodinámica.

Sostuvo además que el uso de cálculo diferencial y límites en física oculta una base discreta: para que las operaciones de límite tengan sentido físico, es natural pensar en un número grande pero finito de elementos. En su lectura, el atomismo resolvía problemas conceptuales del tratamiento continuo.

Boltzmann mostró también la gran capacidad que tenía la teoría cinética para tratar fluctuaciones y fenómenos microscópicos que el continuum no explicaba bien. Los experimentos de Brown con pólenes eran bien conocidos, y otros fenómenos fluctuantes.

Para ilustrar la forma de razonar que empleaban tanto Maxwell como Boltzman en sus problemas de cinética de gases, seguiremos la forma como Boltzmann obtuvo la expresión donde N es el número total de moléculas. Boltzmann supuso (siguiendo la línea iniciada por Bernoulli y Maxwell) que la presión es el resultado de los choques moleculares contra las paredes de un contenedor.

1. Cambio de momento en un choque

Imaginemos una molécula de masa \(m\) moviéndose hacia una pared con velocidad . Al chocar elásticamente y rebotar, su velocidad cambia de

a

. El cambio de momento lineal

es:

2. Fuerza y presión

La fuerza es el cambio de momento por unidad de tiempo. Si el contenedor tiene longitud L, el tiempo entre choques con esa misma pared es . La fuerza promedio F de una molécula es:

La presión P es la fuerza total de N moléculas dividida por el área A de la pared (donde ):

3. Conexión con la Energía Térmica

Boltzmann utilizó el principio de equipartición de la energía, que establece que la energía cinética promedio por cada grado de libertad es . Este principio había sido formulado por Maxwell cuando encontró que, en un gas de partículas que colisionan, la energía cinética promedio se distribuye por igual entre las tres direcciones espaciales (x, y, z), y además la energía promedio por cada molécula es:

. Tenemos pues:

4. Resultado final

Sustituyendo por kT en la ecuación de presión, Boltzmann obtuvo:

PV=NkT

donde N es el número total de moléculas y k es la constante de Boltzmann.

El movimiento browniano

Otra evidencia experimental que respaldó crucialmente la teoría de la naturaleza atómica de la materia fue la del Movimiento Browniano:

En 1827, el botánico Robert Brown observó al microscopio que partículas de polen suspendidas en agua se movían de forma errática y constante. Durante décadas, este fenómeno fue un misterio.

Fue Albert Einstein quien proporcionó en 1905 una explicación teórica de cómo esos movimientos fluctuantes observados por Brown podían ser explicados por choques con moléculas invisibles muy numerosas.

Einstein empezó usando la ecuación de difusión para describir la evolución de partículas suspendidas como los pólenes. La ecuación de difusión unidimensional es:

Con la condición inicial puntual la solución fundamental es la densidad gaussiana:

Esta solución tiene media cero y varianza por lo que el momento segundo (desplazamiento cuadrático medio) viene dado por:

En 1905 no se disponía aún de conceptos como el ruido blanco; la fuerza estocástica con correlación delta, la idea de modelar las colisiones microscópicas como fuerzas estocásticas, la dinámica de procesos estocásticos (Wiener, 1923) o la teoría matemática del cálculo estocástico (Itô, 1944). Por ello, Einstein trabajó con conceptos puramente estadísticos y termodinámicos, no dinámicos. Aquí vamos a utilizar la formulación moderna, más directa, que se basa en la ecuación estocástica de Langevin.

La existencia de fuerzas de rozamiento ya era conocida a principios del s. XX. Stokes había demostrado en 1851 que la fuerza de rozamiento hidrodinámico que sufre una partícula macroscópica esférica de radio a moviéndose lentamente con velocidad v por un fluido de viscosidad viene dada por

, donde

.

Si esa esfera es una partícula de polen que se desplaza debido a fuerzas instantáneas aleatorias provocadas por los choques con átomos y a una fuerza de rozamiento como la de Stockes, podemos representar el proceso mediante la ecuación de Langevin siguiente:

donde F(t) es la fuerza de rozamiento y F’(t) es la fuerza fluctuante. La prima que lleva designa que la fuerza fluctuante cambia aleatoriamente pero con media cero. Si tuviéramos una parte de la fuerza fluctuante que tiene media no nula, la añadiríamos a F(t) en la ecuación de Langevin. El término F’(t) incluye, por definición, sólo fuerzas que no provocan ninguna tendencia en el desplazamiento medio de la partícula. Esto es coherente con una situación de equilibrio térmico, que es la que consideraremos, donde suponemos que no hay ninguna dirección privilegiada para los átomos del fluido (Reif, Fundamentos de física estadística y térmica, Cap. 15.5 y 15.6). Sin embargo, el término F’(t) podría provocar una varianza variable con t en el desplazamiento de la partícula. Para calcularlo, multipliquemos ambos miembros de la ecuación (1) por x y tengamos en cuenta que

. Obtenemos:

Teniendo en cuenta que

sustituimos esta expresión en (2) y tomamos el valor medio en ambos miembros de la expresión resultante. Obtenemos:

Tengamos en cuenta ahora que el valor de la fuerza fluctuante es independiente de la posición x de la partícula, por tanto , pues

. Por otro lado, el teorema de equipartición nos dice que por cada grado de libertad de desplazamiento de un átomo libre, tenemos:

. Sustituyendo en la ecuación, obtenemos:

Esta ecuación puede resolverse de forma inmediata para la variable . El resultado es:

En que C es una constante de integración. Suponiendo que cada partícula de polen parte de x=0 en t=0, la constante C tiene que ser tal que , por tanto la ecuación se transforma en:

Ahora bien, , por tanto hay que integrar una vez más en el tiempo para obtener la evolución de la varianza. El resultado de la integración es:

Esta solución tiene dos casos límites interesantes. Cuando (

) podemos desarrollar en serie la exponencial:

de donde resulta que:

Que al cancelarse los términos constantes y de orden 1, queda:

Observamos que la partícula se comporta inicialmente durante un tiempo muy breve como si fuera una partícula libre moviéndose con una velocidad térmica constante . El otro caso límite es cuando

(

). En este caso la exponencial tiende a cero, por tanto:

Para tiempos grandes la partícula se difunde recorriendo un camino aleatorio, de forma que su varianza crece con el tiempo. Como la ecuación de difusión nos decía que , comparando ambos resultados resulta:

. Utilizando la forma explícita del coeficiente

la varianza puede ser escrita como:

En 3 dimensiones, debido a que los desplazamientos son estadísticamente independientes, la varianza del desplazamiento radial respecto al origen de la partícula sería la suma de las tres varianzas independientes e iguales, esto es, tres veces la obtenida en el caso 1-D:

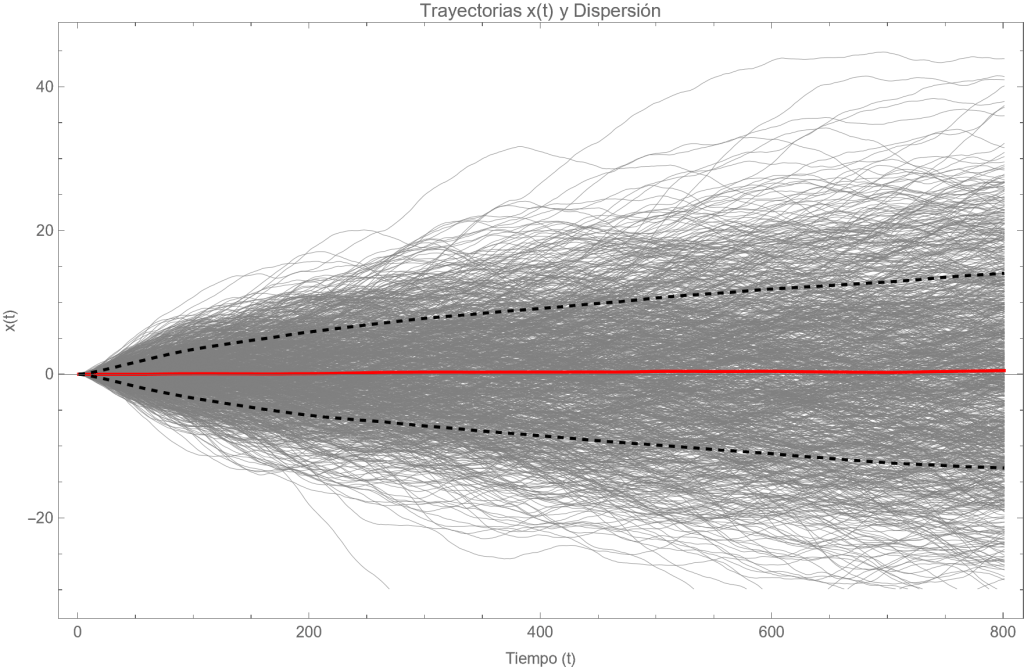

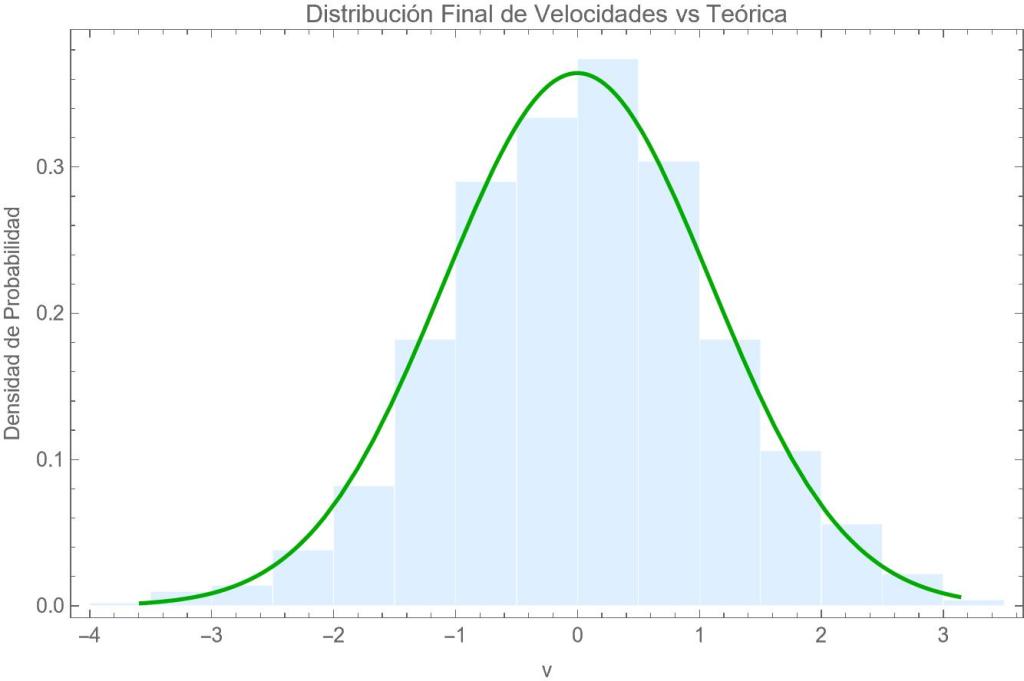

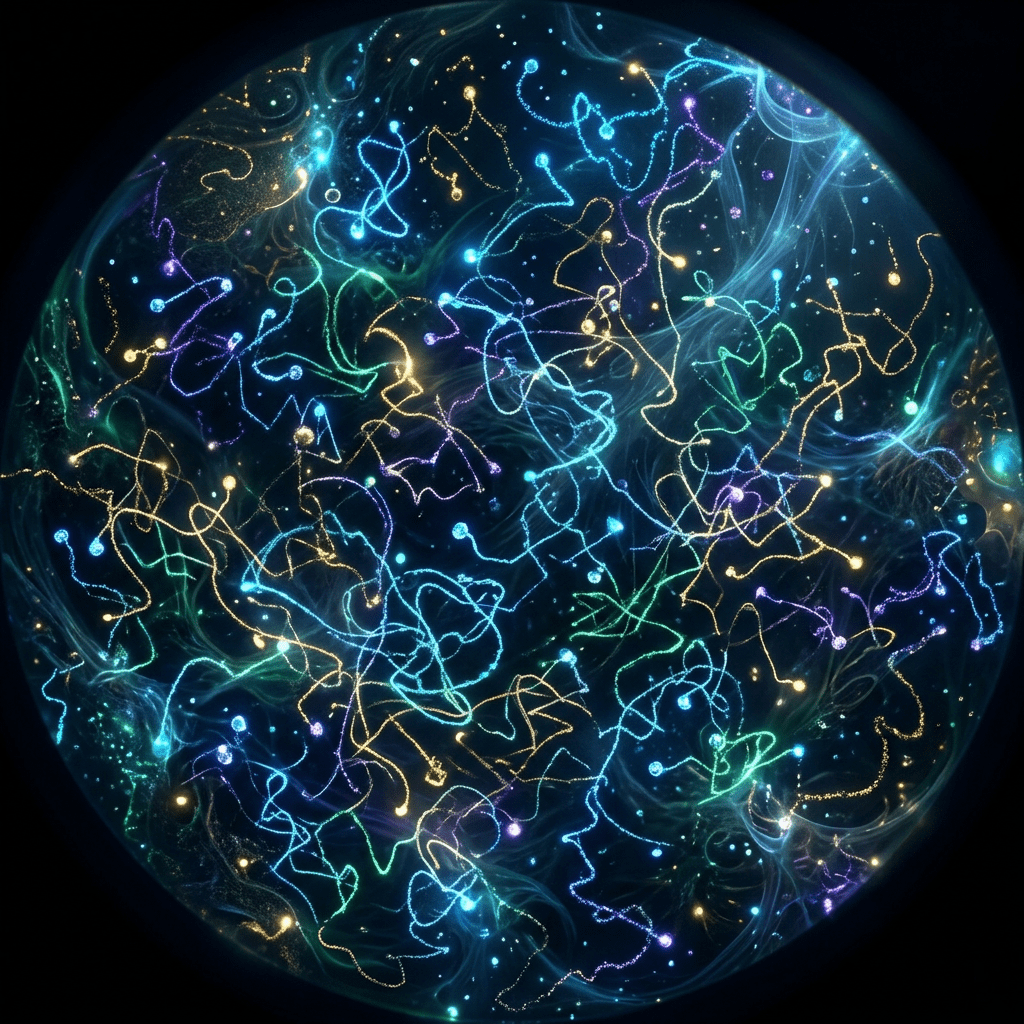

Esto es una consecuencia directa del teorema de equipartición de la energía. Cada grado de libertad (cada dimensión) aporta una cantidad igual de energía cinética promedio y, por tanto, contribuye de la misma manera a la dispersión de la partícula. Al añadir dos dimensiones más, simplemente se triplica la tasa de crecimiento de la varianza total. La figura siguiente muestra el resultado de integrar numéricamente la ecuación de Langevin (1) con un término estocástico F'(t) igual a un ruido blanco (media cero) de varianza $latexs^2 = 2 \alpha k T$. Esta intensidad de fluctuación es la que tiende a ensanchar con el tiempo la distribución de velocidades de las partículas, pues muchas de ellas van acumulando colisiones en las mismas direcciones por puro azar. La distribución de velocidades aumentaría su varianza sin cesar si no fuera porque la fricción aumenta si la velocidad es alta. Una varianza (o intensidad) del ruido blanco s2 igual a la dada arriba es la que garantiza que la distribución de velocidades estacionaria a la que se llega tenga la misma varianza que la distribución de Maxwell-Boltzmann. De hecho, si tenemos una ecuación de Langevin para una velocidad-x de una partícula, con coeficiente de rozamiento

y ruido blanco gaussiano de varianza s2, e imponemos estado estacionario a la solución, se puede demostrar que ésta es una gaussiana cuya varianza viene dada por:

Es el llamado teorema de fluctuación-disipación. Con la elección de

que hemos propuesto arriba, esta expresión se convierte en:

que es el teorema de equipartición de la energía.

Fig. Desplazamiento browniano x(t) en función del tiempo, para un colectivo de 1000 partículas que parten de un mismo lugar y tienden al equilibrio térmico. La desviación típica y su negativo (líneas a trazos) se amplían proporcionalmente a t1/2 aproximadamente

La figura siguiente muestra el grado de aproximación con que el colectivo se ha aproximado a la distribución de equilibrio térmico en el momento final del cálculo.

Hoy en día, con los ordenadores, los lenguajes de programación matemática (Fortran, C,…), el software que facilita la programación matemática (MatLab, Mathematica, Python,…) y los generadores de números aleatorios, la resolución de esta clase de ecuaciones es relativamente sencilla. A principios del siglo XX no era así.

Para tiempos grandes y equilibrio térmico con el medio, la varianza de las velocidades de las partículas brownianas permanece constante, pero la varianza del desplazamiento en la dirección x sigue creciendo proporcionalmente a t. Esta dispersión puede ser medida experimentalmente de tres maneras alternativas: (i) observando a una partícula única en experimentos iguales repetidos muchas veces; (ii) colocando muy juntas muchas partículas iguales y observando o fotografiando cómo se dispersa el conjunto en distintos tiempos; (iii) distribuyendo homogéneamente un conjunto de partículas en un recipiente casi plano (2-D) o tridimensional, y midiendo con un microscopio cuanto se separa cada una de las partículas de su posición inicial durante un intervalo dado de tiempo.

Entre 1908 y 1909, Jean Perrin realizó una serie de experimentos extremadamente precisos sobre partículas microscópicas suspendidas en líquidos. Utilizó el tercero de los métodos comentados, siguiendo el desplazamiento de muchas partículas individuales a lo largo de un solo plano, mediante un microscopio, y proyectando sobre un único eje el desplazamiento observado. A partir de la expresión teórica de la varianza para una dimensión (ecuación 7), conociendo el tamaño de las partículas y la viscosidad del medio, pudo obtener un valor suficientemente preciso de la constante de Boltzmann k.

Ahora bien, la teoría cinética de Boltzmann había explicado el comportamiento de los gases ideales mediante la fórmula: donde N es el número total de moléculas y k la constante luego llamada de Boltzmann. Comparando esta expresión con la clásica de los gases ideales PV = nRT, resulta que debería ser nR = NK. Pero sabemos que el número total de moléculas es igual al número de moles multiplicado por el número de Avogadro NA:

. Resulta pues que

.

Por tanto, conociendo el valor de la constante R de los gases, Perrin pudo estimar el valor del número de Avogadro. Sus resultados:

- verificaron cuantitativamente las ecuaciones de Einstein (1905) sobre el desplazamiento medio cuadrático de las partículas brownianas;

- confirmaron que el movimiento browniano sólo podía explicarse si la materia estaba formada por átomos y moléculas, que chocaban continuamente con las partículas visibles;

- permitieron calcular el tamaño de los átomos y el número de Avogadro a partir de observaciones directas, algo nunca logrado antes.

Ostwald, escéptico hasta entonces, reconoció públicamente que los átomos eran reales.

La Radiactividad

Mientras que el movimiento browniano comenzó a convencer a la comunidad científica sobre la existencia real de los átomos, los experimentos relacionados con la radiactividad empezaron a revelar que tales átomos tenían estructura interna.

La radiactividad fue descubierta por Becquerel y los Curie y las desintegraciones radioactivas fueron estudiadas por Rutherford y Soddy. Tales experimentos aportaron tres pruebas clave:

- La divisibilidad del átomo: Hasta entonces, el átomo era, por definición, «indivisible» (del griego atomos). El hecho de que un átomo de uranio pudiera expulsar una partícula alfa y transformarse en otro elemento demostró que el átomo tenía componentes internos y una estructura compleja.

- La evidencia de partículas subatómicas: Los experimentos de Rutherford con partículas alfa (núcleos de helio) permitieron «ver» el interior del átomo. Al observar cómo estas partículas rebotaban, Rutherford demostró la existencia del núcleo atómico en 1911.

- Contar átomos individualmente: Los detectores de partículas (como el contador de centelleo) permitían observar eventos producidos por un solo átomo. Esto convirtió a los átomos de ser una «conjetura útil» para los químicos a ser entidades físicas discretas que se podían contar y seguir individualmente.

Además, Rutherford y Geiger obtuvieron el número de Avogadro NA mediante un experimento brillantemente simple en 1908, basado en la desintegración alfa del Radio. Su estrategia consistió en contar directamente cuántas partículas individuales emitía una muestra y medir simultáneamente el volumen total de gas que esas partículas formaban al acumularse. El experimento consistió en:

- Contar las partículas (N): Utilizaron un detector de centelleo y un contador eléctrico primitivo (el precursor del contador Geiger) para contar cuántas partículas alfa (

) emitía un gramo de Radio por segundo. Determinaron que eran aproximadamente

partículas por segundo.

- Capturar el gas: Rutherford sabía que las partículas alfa eran núcleos de Helio. Dejó que una muestra de Radio emitiera estas partículas durante un tiempo prolongado dentro de un recipiente sellado al vacío, donde las partículas alfa capturaban electrones y se convertían en gas Helio estable.

- Medir el volumen acumulado (V): Al cabo de un año, midieron cuánto volumen ocupaba ese gas en condiciones normales de presión y temperatura.

Sabiendo cuántas partículas habían sido emitidas (el número total de átomos de Helio) y qué volumen de gas ocupaban, Rutherford pudo calcular cuántos átomos se necesitaban para llenar un mol de gas (22.4 litros).

El valor que obtuvo Rutherford fue de aproximadamente , una cifra asombrosamente cercana al valor que Einstein había predicho teóricamente y que Perrin había medido con el movimiento browniano

.

Los dos métodos eran radicalmente distintos: el de Einstein/Perrin basado en la agitación observable de partículas suspendidas en agua (termodinámica) y el de Rutherford, basado en la desintegración espontánea de núcleos atómicos (física nuclear). Que ambos métodos dieran el mismo número convenció finalmente incluso a los escépticos más duros (como Ernst Mach) de que los átomos eran reales.

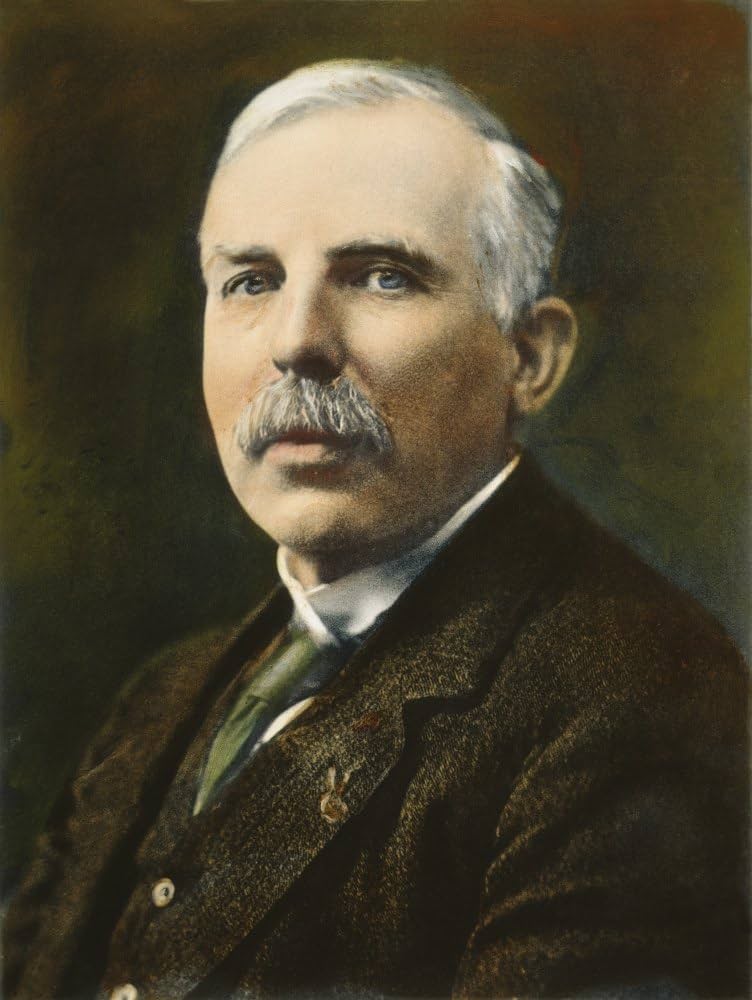

El experimento de la lámina de oro de Rutherford

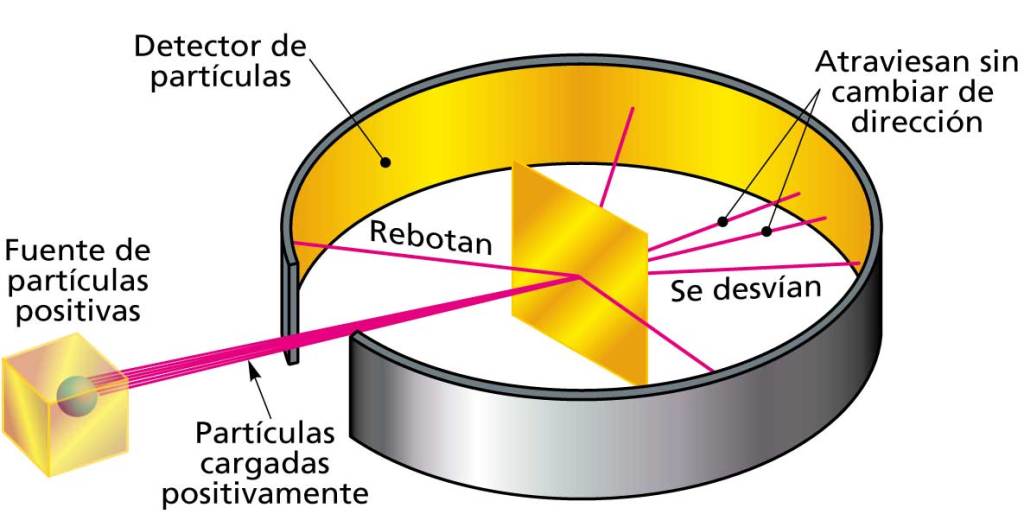

Este famoso experimento fue realizado en 1909 por Hans Geiger y Ernest Marsden bajo la dirección de Ernest Rutherford. [1, 2] El montaje experimental consistía en:

- Una fuente radiactiva: Utilizaron una muestra de polonio que emitía partículas alfa (núcleos de helio, con carga positiva y mucha energía).

- Un blanco: Una finísima lámina de oro (de apenas unos pocos átomos de espesor).

- Un detector: Una pantalla de sulfuro de zinc que emitía un pequeño destello de luz (centelleo) cuando una partícula alfa chocaba contra ella. [1, 2, 3, 4, 5]

Rutherford sospechaba que las partículas alfa eran helio desde hacía años, pero necesitaba una prueba física irrebatible. Para lograrlo, en 1908 diseñó un experimento de «atrapamiento» extremadamente ingenioso, junto con Thomas Royds: [1]

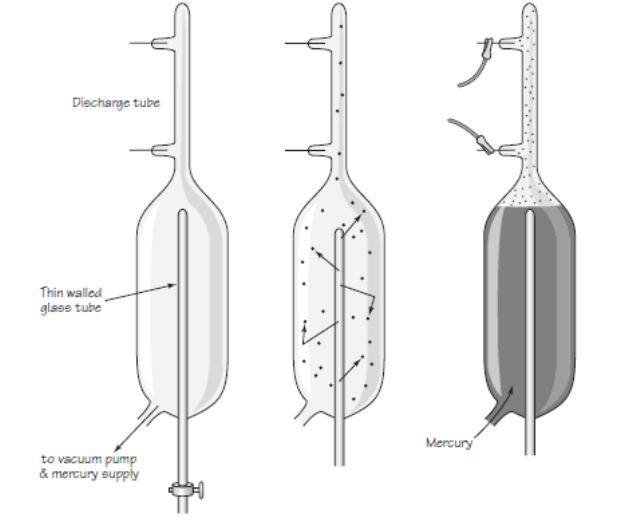

Colocaron una muestra de gas radón (emisor alfa) dentro de un tubo de vidrio de paredes tan delgadas que las partículas alfa podían atravesarlas pero no el radón. Este tubo delgado estaba rodeado por otro tubo de vidrio más grueso donde se había hecho el vacío absoluto. Las partículas alfa atravesaban la primera pared, quedaban atrapadas en el espacio vacío del segundo tubo y, tras ganar electrones de las paredes, se convertían en átomos de gas neutro.

Tras dejar que el gas se acumulara durante una semana, concentraron el gas obtenido inyectando mercurio, y aplicaron una descarga eléctrica al tubo exterior para analizar la luz emitida (espectroscopia). La luz emitida mostró exactamente las mismas líneas espectrales características del helio. Rutherford escribió:

«Los experimentos demuestran de manera concluyente que la partícula alfa, tras perder su carga, es un átomo de helio». Este descubrimiento le valió el Premio Nobel de Química ese mismo año.

Fig. Experimento de Rutherford y Royds

Un año después, en 1909, cuando diseña el experimento de la lámina de oro, el modelo más aceptado para el átomo era el de Thomson (el «budín de pasas»), donde un conjunto de pequeños electrones de masa 2.000 veces más ligera que el hidrógeno estaban repartidos en un volumen de carga positiva distribuida uniformemente. Se esperaba que todas las partículas alfa atravesaran el oro con desviaciones mínimas. [1, 2, 3, 4] Sin embargo, observaron tres cosas:

- La gran mayoría de las partículas atravesaban la lámina sin desviarse.

- Algunas sufrían desviaciones pequeñas.

- Unas pocas (1 de cada 8,000 aproximadamente) rebotaban hacia atrás (!). [1, 2, 3, 4, 5]

Rutherford quedó tan sorprendido con estos últimos resultados que comentó que era como «disparar una bala de cañón a un trozo de papel de seda y que esta rebotara y te golpeara».

Fig. Experimento de la lámina de oro de Rutherford

Estos rebotes dieron una información preciosa a Rutherford: el tamaño aproximado de la partícula de carga positiva que los provocaba. Para determinar el tamaño del núcleo de repulsión, Rutherford analizó el punto en el que una partícula alfa (con carga ) se detiene por completo al aproximarse frontalmente a un núcleo de oro (con carga

). En ese punto, toda la energía cinética se transforma en energía potencial eléctrica.

La igualdad entre la energía cinética inicial K y la energía potencial de Coulomb U en la distancia de máximo acercamiento d es:

Al despejar d, obtenemos la expresión que define el límite superior del radio del núcleo:

Sustituyendo los valores experimentales, donde Z = 79 para el oro y , Rutherford obtuvo un valor de:

Dado que el radio del átomo es del orden de , esta relación demostró que el núcleo es miles de veces más pequeño que el átomo:

Todo esto le llevó a concluir que: [1]

- El átomo es mayormente espacio vacío (por eso la mayoría de partículas

pasan de largo).

- Toda la carga positiva y casi toda la masa están concentradas en una región central pequeñísima: el núcleo.

- El núcleo debe ser muy denso y tener carga positiva, lo suficientemente fuerte como para repeler electrostáticamente a una partícula alfa que se acerque demasiado. [1, 2, 3, 4, 5]

Con este experimento, Rutherford inauguró el siglo de la Física Nuclear, inventó el método de la dispersión o scattering para investigar la estructura interna de la materia, y propuso un primer modelo de la estructura interna del átomo a imagen de un sistema solar, con electrones negativos girando alrededor de un núcleo positivo. Esto generó problemas de consistencia con el electromagnetismo clásico que inspiraron a una generación de físicos brillantes: Bohr, Lorentz, Sommerfeld, Haas, Nicholson y Lewis. A los que siguieron los fundadores de la Mecánica Cuántica moderna.

Imagen. Ernest Rutherford (1871-1937)

Podemos decir que el periodo entre 1808 y 1908 fue clave para la conversión de la mayoría de los científicos a la teoría de que la materia estaba compuesta de átomos. 1808 fue el año en que John Dalton publicó la primera parte de su obra fundamental, Nuevo sistema de filosofía química, donde formalizó sus postulados sobre los átomos como esferas indivisibles e idénticas para cada elemento químico; y 1908 fue el año en que Jean Perrin demostró experimentalmente la corrección de la teoría del movimiento browniano de Einstein, y en que Ernest Rutherford pudo obtener el valor del número de Avogadro contando el número de partículas alfa acumuladas en un depósito como átomos de helio.

La ciencia había pasado en 100 años de creer que “la materia es continua” a pensar que “la materia está constituida por átomos discretos”. Esto fue el comienzo de una revolución que continuó en las primeras décadas del siglo XX con la Mecánica Cuántica, y que hemos explorado en otros dos artículos (Conceptos fundamentales de la Mecánica Cuántica y su origen histórico y La interpretación filosófica de la mecánica cuántica).

Deja un comentario